الذكاء الاصطناعي

| جزء من سلسلة عن |

| الذكاء الاصطناعي |

|---|

الذكاء الاصطناعي إنگليزية: Artificial intelligence (AI) هو الذكاء — الإدراك والتوليد والاستدلال بالمعلومات - الذي يتم تجسيده في الآلات، بدلاً من الذكاء الذي تسلكه الحيوانات والكائنات الحية المغايرة للبشر أو البشر. ومن بين المهام التي يتم فيها ذلك تحويل الكلام إلى نص، والرؤية الحاسوبية، والترجمة بين اللغات الطبيعية، وكذلك تعيينات أخرى للمدخلات.

تشمل تطبيقات الذكاء الاصطناعي محركات البحث الويب المتقدمة (مثل بحث جوجل)، ونظم التوصية (التي تستخدمها يوتيوب وأمازون ونت فليكس)، وفهم الكلام البشري (مثل سيري وألكسا)، والسيارات ذاتية القيادة (مثل وايمو)، وأدوات التوليد أو الإبداع (مثل ChatGPT وAI art)، واتخاذ القرارات التلقائية، والمنافسة على أعلى مستوى في أنظمة الألعاب الاستراتيجية (مثل الشطرنج ولعبة جو).[1]

مع زيادة قدرة الآلات، يتم استبعاد المهام التي يعتبرها الناس تتطلب "ذكاءً" من تعريف الذكاء الاصطناعي، وهو ما يعرف باسم "تأثير الذكاء الاصطناعي"[2]. وعلى سبيل المثال، يتم استبعاد التعرف البصري على المحارف من المواضيع التي يتم اعتبارها ذكاء اصطناعي، إذ أصبحت تكنولوجيا روتينية.[3]

تأسس الذكاء الاصطناعي كتخصص أكاديمي في عام 1956، وفي السنوات التي تلت ذلك شهدت عدة موجات من التفاؤل[4][5] تلتها خيبة أمل وفقدان التمويل (معروف باسم "شتاء الذكاء الاصطناعي")[6][7] تلاها نهج جديد ونجاح وتمويل جديد.[5][8] لقد حاول البحث في الذكاء الاصطناعي العديد من النهج المختلفة، بما في ذلك محاكاة الدماغ ونمذجة حل المشكلات البشرية والمنطق المنهجي وقواعد البيانات الضخمة للمعرفة ومحاكاة سلوك الحيوانات. في العقود الأولى من القرن 21، غالباً ما هيمن التعلم الآلي الرياضي والإحصائي على المجال، ولقد ثبت أن هذه التقنية ناجحة للغاية، مما ساعد على حل العديد من المشاكل الصعبة في جميع أنحاء الصناعة والأكاديمية.[8][9]

تدور مختلف الفروع البحثية في مجال الذكاء الاصطناعي حول أهداف محددة واستخدام أدوات معينة. تشمل الأهداف التقليدية للبحث في الذكاء الاصطناعي الاستدلال وتمثيل المعرفة والاستنتاج والتخطيط والتعلم ومعالجة اللغات الطبيعية والإدراك والقدرة على تحريك الأجسام ومعالجتها. [أ]. والذكاء العام (القدرة على حل مشكلة عشوائية) هو واحد من أهداف المجال على المدى الطويل.[10]لحل هذه المشاكل، عمل الباحثون في الذكاء الاصطناعي على تكييف ودمج مجموعة واسعة من تقنيات حل المشكلات، بما في ذلك البحث والتحسين الرياضي والمنطق الرسمي والشبكات العصبونية الاصطناعية والأساليب القائمة على الإحصاء والاحتمالات والاقتصاد. كما يستفيد الذكاء الاصطناعي من علوم الحاسوب وعلم النفس واللغويات والفلسفة والعديد من المجالات الأخرى.

تأسس هذه المجال على افتراض أن الذكاء البشري "يمكن وصفه بدقة بحيث يمكن صنع آلة لتحاكيه"[ب] وقد أثار ذلك الأمر حججاً فلسفية حول الفكر والعواقب الأخلاقية لخلق كائنات اصطناعية مزودة بذكاء يشبه البشر؛ وكانت هذه المسائل قد استكشفت سابقاً من خلال الأساطير والخيال والفلسفة منذ القدم.[12]ومنذ ذلك الحين، اقترح علماء الحاسوب والفلاسفة أن يمكن أن يشكل الذكاء الاصطناعي خطراً قائماً على الوجود البشري إذا لم يتم توجيه القدرات العقلية نحو أهداف مفيدة.[ت] كما انتُقد مصطلح الذكاء الاصطناعي أيضاً لتضخيم قدرات التكنولوجيا الحقيقية للذكاء الاصطناعي.[13][14][15]

تاريخ

ظهرت الكائنات الاصطناعية ذات الذكاء كأدوات روائية في العصور القديمة،[16]وكانت شائعة في الأدب، مثل رواية فرانكنشتاين لماري شلي وآر. يو. آر لكارل تشابك[17] وقد أثارت شخصيات هذه الروايات ومصائرها العديد من القضايا التي يتم مناقشتها الآن في مجال أخلاقيات الذكاء الاصطناعي.[18]

بدأت دراسة الاستنتاج الميكانيكي أو "المنطقي" مع الفلاسفة والرياضيين في العصور القديمة. أدت دراسة المنطق الرياضي مباشرةً إلى نظرية الحوسبة آلان تورنغ، التي اقترحت أن الآلة، من خلال تبديل الرموز بأبسط صورة ممكنة، مثل "0" و "1"، يمكنها محاكاة أي عمل من عمليات الاستنتاج الرياضي الممكنة. وهذا الإدراك أن الحاسوب الرقمي يمكنه محاكاة أي عملية للاستنتاج الشكلي يعرف باسم نظرية تشرتش-تورنغ.[19]. وقد أدى ذلك، جنباً إلى جنب مع الاكتشافات المتزامنة في علم الأعصاب ونظرية المعلومات ووعلم التحكم الآلي، إلى اعتبار إمكانية بناء دماغ إلكتروني.[20] وكانت أول أعمال الذكاء الاصطناعي المعترف بها عموماً هي التصميم الشكلي الذي قدمه ماكولوش وبيتس عام 1943 لـ Turing completeness التي يمكن برمجتها لإتمام مهام حسابية معينة.[21]

في الخمسينيات من القرن الماضي، ظهرت رؤيتان حول كيفية تحقيق الذكاء الآلي. الرؤية الأولى، والمعروفة باسم الذكاء الاصطناعي الرمزي أو GOFAI، هي استخدام الحواسيب لإنشاء تمثيل رمزي للعالم ونظم يمكنها التفكير في العالم. وكان من بين المؤيدين لهذا النهج ألن نيويل وهربرت سايمون ومارفن مينسكي. وكان النهج الذي يشبه هذا النهج بشكل كبير هو النهج "البحث التكاملي"، الذي يشبه الذكاء مسألة استكشاف الفضاء المحتمل للإجابات.

الرؤية الثانية، والمعروفة باسم النهج الاتصالي، سعت إلى تحقيق الذكاء من خلال التعلم. وكان أبرز مؤيدي هذا النهج فرانك روزنبلات، حيث سعى لربط البرسبترونات بطرق مستوحاة من اتصالات العصبونات..[22] قارن جيمس مانيكا وغيره من المؤرخين بين النهجين عن طريق مقارنة العقل (الذكاء الاصطناعي الرمزي) والدماغ (النهج الاتصالي). يرى مانيكا أن النهج الرمزي كان الأكثر انتشاراً في فترة الدفع للحصول على الذكاء الاصطناعي، نظرًا لارتباطه بالتقاليد الفكرية لديكارت وبول وغوتلوب فريجه وبرتراند رسل وغيرهم. تم إبعاد النهج الاتصالي القائم على علم القيادة أو التحكم أو الشبكات العصبية الاصطناعية إلى الخلفية، لكنها اكتسبت أهمية جديدة في العقود الأخيرة.[23]

ولد مجال البحث في الذكاء الاصطناعي في ورشة عمل عُقِدت في كلية دارتموث عام 1956.[ث][26] حضر الورشة الأساتذة والخبراء في مجال الذكاء الاصطناعي.[ج] وأصبحوا مؤسسي وقادة البحث في هذا المجال. وقاموا وطلابهم بإنتاج برامج وصفتها الصحف بأنها "مذهلة":[ح] حيث تعلم الحاسوب استراتيجيات الشطرنج وحل مشاكل الجبر وإثبات الأطروحات المنطقية والتحدث باللغة الإنجليزية.[خ][28]

في منتصف الستينات، كان البحث في الولايات المتحدة ممولًا بشكل كبير من قِبل وزارة الدفاع[29]وتم إنشاء مختبرات في جميع أنحاء العالم.[30]

كان الباحثون في الستينيات والسبعينيات على يقين من أن النهج الرمزي سينجح في نهاية المطاف في إنشاء آلة ذات ذكاء اصطناعي عام[31]، واعتبروا هذا هدف مجالهم.[31] توقع هربرت سايمون "أن تكون الآلات، في غضون عشرين عاماً، قادرة على القيام بأي عمل يستطيع الإنسان القيام به.[32] ووافق مارفن مينسكي، حيث كتب "في غضون جيل ... سيتم حل مشكلة إنشاء 'الذكاء الاصطناعي' بشكل كبير".[33]

فشلوا في الاعتراف بصعوبة بعض المهام المتبقية، مما أدى إلى تباطؤ التقدم في هذا المجال، وفي عام 1974، ورداً على انتقادات السير جيمس لايتهل[34] والضغوط المستمرة من الكونغرس الأمريكي لتمويل مشاريع أكثر إنتاجية، قطعت الحكومتان الأمريكية والبريطانية التمويل عن البحوث الاستكشافية في مجال الذكاء الاصطناعي. وأطلق على السنوات القليلة اللاحقة عبارة "شتاء الذكاء الاصطناعي"، وهي فترة تميزت بصعوبة الحصول على تمويل لمشاريع الذكاء الاصطناعي.[6]

في أوائل الثمانينات، تم إحياء البحث في الذكاء الاصطناعي بفضل النجاح التجاري للنظم الخبيرة[35] وهي شكل من برامج الذكاء الاصطناعي التي تحاكي معرفة ومهارات التحليل للخبراء البشريين. وبحلول عام 1985، وصلت قيمة السوق للذكاء الاصطناعي إلى أكثر من مليار دولار. في الوقت نفسه، ألهم مشروع الحاسوب الجيل الخامس الياباني الحكومتين الأمريكية والبريطانية لاستعادة التمويل للبحث الأكاديمي.[5] ومع ذلك، بدءاً من انهيار سوق ماكينات ليسب في عام 1987، انخفضت شعبية الذكاء الاصطناعي مرة أخرى وبدأ شتاء ذكاء اصطناعي ثاني يستمر لفترة أطول.[7]

بدأ العديد من الباحثين بالتشكيك في إمكانية النهج الرمزي في تقليد جميع عمليات الإدراك البشري، وخاصةً في مجالات الإدراك والروبوتات والتعلُّم والتعرف على الأنماط. وبدأ العديد من الباحثين يبحثون في النهج "الشبه رمزي" لمعالجة مسائل الذكاء الاصطناعي المحددة.[36] رفض باحثو الروبوتات، مثل رودني بروكس، الذكاء الاصطناعي الرمزي وركّزوا على المسائل الهندسية الأساسية التي تسمح للروبوتات بالحركة والبقاء على قيد الحياة وتعلُّم بيئتها.[د]

تم إحياء الاهتمام بالشبكات العصبية و"الاتصالية" من قبل جيفري هنتون وديفيد روملهارت وآخرين في منتصف الثمانينيات.[41] تم تطوير أدوات الحوسبة اللينة في الثمانينيات، مثل الشبكات العصبية والأنظمة الضبابية ونظرية النظام الرمادي والتحسيب التطوري والعديد من الأدوات المستمدة من الإحصاء أو الأمثلية الرياضية.

استعاد الذكاء الاصطناعي تدريجياً سمعته في أواخر التسعينيات وأوائل القرن الحادي والعشرين من خلال العثور على حلول محددة لمشكلات محددة. فالتركيز الضيق سمح للباحثين في هذا المجال بإنتاج نتائج قابلة للتحقق، واستخدام أساليب رياضية أكثر تطوراً، والتعاون مع مجالات أخرى (مثل الإحصاء والاقتصاد والرياضيات).[42] وبحلول عام 2000، كانت الحلول التي وضعها باحثو الذكاء الاصطناعي تستخدم على نطاق واسع، على الرغم من أنها كانت نادراً ما توصف بأنها "ذكاء اصطناعي" في التسعينيات.[9]

تمكّنت الحواسيب الأسرع والتحسينات الخوارزمية والوصول إلى كميات ضخمة من البيانات من تحقيق تقدمات في تعلّم الآلة والإدراك؛ وبدأت الطرق العميقة التي تعتمد على البيانات بشكل كبير في تحقيق أفضل النتائج في مجال الدقة حوالي عام 2012.[43] وفقاً لـ"جاك كلارك" من بلومبرغ، كان عام 2015 عاماً حاسماً للذكاء الاصطناعي، حيث زاد عدد مشاريع البرمجيات التي تستخدم الذكاء الاصطناعي داخل "جوجل" من "استخدام عشوائي" في عام 2012 إلى أكثر من 2700 مشروع.[ذ] ويعزو ذلك إلى زيادة في شبكات العصبونية بسبب ارتفاع البنية التحتية للحوسبة السحابية وزيادة في أدوات البحث والمجموعات البيانية.[8]

في استطلاع للرأي عام 2017، أفادت إحدى كل خمس شركات بأنها "دمجت الذكاء الاصطناعي في بعض العروض أو العمليات".[44]كما زادت كمية البحوث حول الذكاء الاصطناعي (التي يتم قياسها بمجموع النشرات) بنسبة 50٪ في الفترة من عام 2015 إلى 2019.[45]

أصاب العديد من الباحثين الأكاديميين القلق من أن الذكاء الاصطناعي لم يعد يسعى إلى الهدف الأساسي لإنشاء آلات متعددة الاستخدامات وذات كاملة الذكاء. وتتضمن الكثير من الأبحاث الحالية الذكاء الاصطناعي الإحصائي، الذي يستخدم بشكل ساحق لحل مشاكل محددة، حتى التقنيات الناجحة جداً مثل التعلم العميق. وأدى هذا القلق إلى ظهور مجال فرعي في الذكاء الاصطناعي يسمى "الذكاء العام" (أو "AGI")، والذي كانت له عدة مؤسسات مدعومة بالتمويل في العقد الأول من القرن الحالي.[10]

في أبريل 2023، نشر عالم الحاسوب جارون لانير رؤية بديلة حول الذكاء الاصطناعي في مجلة ذا نيويوركر حيث يعتبر أن الذكاء الاصطناعي أقل ذكاءً مما يوحي به الاسم والثقافة الشعبية. وختم لانير مقاله قائلاً: "لنفكر في البشر. فهم الإجابة على مشاكل البتات."[46][47]

الأهداف

قُسّمت المشكلة العامة لمحاكاة (أو إنشاء) الذكاء إلى مشكلات فرعية. تتألف هذه المشكلات من سمات أو قدرات محددة يتوقع من الباحثين أن يعرضها نظام ذكي. وتلقى الصفات الموضحة أدناه أكثر اهتماماً.[أ]

الاستدلال، حل المشكلات

طوّر الباحثون الأوائل خوارزميات تقلد الاستدلال خطوة بخطوة الذي يستخدمه البشر عند حل الألغاز أو عند إجراء استنتاجات منطقية.[48] وفي أواخر الثمانينات والتسعينات، تمكنت البحوث في مجال الذكاء الاصطناعي من تطوير طرق للتعامل مع المعلومات غير المؤكدة أو غير المكتملة، باستخدام مفاهيم من الاحتمالات والاقتصاد.[49]

ثبت أن العديد من هذه الخوارزميات غير كافية لحل مشاكل الاستدلال الكبيرة بسبب ما يُعرف بـ "الانفجار المجمعي"، حيث يصبحون أبطأ بشكل تفاضلي كلما زادت حجم المشكلة.[50] حتى البشر نادراً ما يستخدمون الاستنتاج خطوة بخطوة الذي كان يمكن للذكاء الاصطناعي الأولي نمذجته. فهم يحلون معظم مشاكلهم باستخدام قرارات سريعة وبديهية.[51]

تمثيل المعرفة

تسمح تمثيل المعرفة وهندسة المعرفة[52] لبرامج الذكاء الاصطناعي بالإجابة عن الأسئلة بذكاء وإجراء استنتاجات حول حقائق العالم الحقيقي.

تمثيل "ما هو موجود" هو أنطولوجية: مجموعة الكائنات والعلاقات والمفاهيم والخصائص التي يتم وصفها بشكل رسمي بحيث يمكن لعمليات البرمجيات فهمها. [53]وتسمى الأونتولوجيات العامة العليا بمفهوم "upper ontologies" والتي تحاول توفير أساس لجميع المعارف الأخرى وتعمل كوسطاء بين أونتولوجيات المجالات التي تغطي المعرفة المحددة حول نطاق معين من المعرفة (مجال الاهتمام). وسيحتاج البرنامج الذكي أيضاً إلى الوصول إلى المعرفة السليمة؛ وهي مجموعة الحقائق التي يعرفها الشخص العادي. وتتمثل الدلالة الحسية للأونتولوجيا عادة في لغة الوصف المنطقي، مثل لغة أنطولوجيا الويب (Web Ontology Language).[54]

أدّت بحوث الذكاء الاصطناعي إلى تطوير أدوات لتمثيل مجالات محددة مثل الأشياء والخصائص والفئات والعلاقات بين الأشياء.[54]وتشمل هذه الأدوات أيضاً تمثيل المواقف والأحداث والحالات والزمن.;[55] وكذلك تمثيل الأسباب والنتائج;[56] والمعرفة المتعلقة بالمعرفة (ما نعرفه عن ما يعرفه الآخرون);.[57]والاستدلال الافتراضي (الأمور التي يفترضها البشر أنها صحيحة حتى يتم إخبارهم بغير ذلك وسوف تظل صحيحة حتى عندما تتغير الحقائق).[58] وتعتبر من بين أصعب المشاكل في الذكاء الاصطناعي: تنوع المعرفة الشائعة (عدد الحقائق الذرية التي يعرفها الشخص العادي كبير جداً);[59]والشكل الدون رمزي لمعظم المعرفة الشائعة (حيث إن الكثير مما يعرفه الناس لا يتم تمثيله كـ "حقائق" أو "صياغات" يمكنهم التعبير عنها بالكلام).[51]

تستخدم التمثيلات الرسمية للمعرفة في فهرسة واسترداد المحتوى بناءً على المحتوى.[60] وتفسير المشاهد،[61] والدعم في اتخاذ القرارات السريرية،[62] واكتشاف المعرفة (استخلاص الاستدلالات "المثيرة للاهتمام" والقابلة للتطبيق من قواعد البيانات الضخمة)،[63] وغيرها من المجالات.[64]

التعلم

يعتبر التعلم الآلي (Machine Learning - ML) مفهوماً أساسياً في بحث الذكاء الاصطناعي (AI) منذ بدايته,[ر] وتعني الدراسة التي تركز على خوارزميات الحاسوب التي تتحسن تلقائياً من خلال التجربة.[ز]

يقوم تعلم غير مراقب بالعثور على الأنماط في دفق المدخلات.

يتطلب التعلم المراقب من الإنسان تسمية بيانات المدخلات أولاً، ويأتي في نوعين رئيسيين: التصنيف والانحدار العددي. يستخدم التصنيف لتحديد أي فئة ينتمي إليها شيء ما - حيث يرى البرنامج عدداً من الأمثلة للأشياء من عدة فئات ويتعلم كيفية تصنيف المدخلات الجديدة. والانحدار هو محاولة إنتاج وظيفة تصف العلاقة بين المدخلات والمخرجات ويتنبأ بكيفية تغيير المخرجات مع تغيير المدخلات. يمكن اعتبار كل من المصنفات ومتعلمات الانحدار على أنها "تقريبات وظيفية" تحاول تعلم وظيفة مجهولة (وربما ضمنية)؛ على سبيل المثال، يمكن اعتبار مصنف الرسائل العشوائية على أنه يتعلم وظيفة ترتبط نص البريد الإلكتروني بإحدى الفئتين "رسالة عشوائية" أو "ليست رسالة عشوائية".[68]

في التعلم المعزز، يتم مكافأة الوكيل عندما يتفاعل بشكل جيد ويتم عقابه عندما يتفاعل بشكل سيء. يقوم الوكيل بتصنيف ردوده لتشكيل استراتيجية للعمل في فضاء مشكلته.[69]

التعلّم الانتقالي هو عندما يتم تطبيق المعرفة المكتسبة من مسألة واحدة على مسألة جديدة.[70]

يمكن لنظرية التعلم الحسابي تقييم المتعلمين من خلال التعقيد التحسيبي اللازم، أو من خلال تعقيد عينة البيانات المطلوبة (كمية البيانات المطلوبة)، أو من خلال مفاهيم أخرى للاستمثال.[71]

معالجة اللغات الطبيعية

تسمح معالجة اللغة الطبيعية (NLP)[72] للآلات بقراءة وفهم اللغة الإنسانية. وسيؤدي نظام معالجة اللغة الطبيعية قوي بما فيه الكفاية إلى تمكين واجهات المستخدم الطبيعية للغة واكتساب المعرفة مباشرة من المصادر المكتوبة باللغة الإنسانية، مثل نصوص وكالات الأنباء. وتشمل بعض التطبيقات المباشرة لـ NLP استرجاع المعلومات والإجابة على الأسئلة والترجمة الآلية.[73]

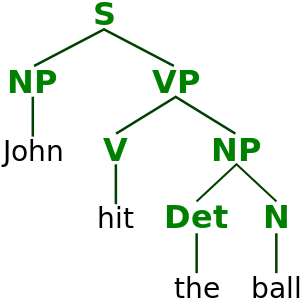

استخدم الذكاء الاصطناعي الرمزي (Symbolic AI) بناء الجملة الرسمية لترجمة البنية العميقة للجمل إلى منطق.[50] لم يتمكن هذا النهج من إنتاج تطبيقات مفيدة بسبب استعصاء المنطق وعرض المعرفة الشائعة.[59] تتضمن التقنيات الإحصائية الحديثة ترددات التكرار المتزامنة (مدى تكرار كلمة بالقرب من كلمة أخرى)، والعثور على الكلمات المفتاحية (للبحث عن كلمة معينة لاسترداد المعلومات)، والتعلم الآلي العميق على أساس التحويلات (التي تجد الأنماط في النص) وغيرها.[74]وقد حققت هذه التقنيات دقة مقبولة على مستوى الصفحة أو الفقرة، وبحلول عام 2019، كانت قادرة على إنتاج نص متسق.[75]

الإدراك حسي

إدراك الآلة[76](Machine perception) هو القدرة على استخدام إشارات الاستشعار (مثل الكاميرات والميكروفونات والإشارات اللاسلكية والأجهزة الحسية النشطة مثل الليدار والسونار والرادار والحساسات التلامسية) لاستنتاج جوانب من العالم. وتتضمن التطبيقات التعرف على الكلام[77] facial recognition, and إدراك الأشياء.[78] والرؤية الحاسوبية هي القدرة على تحليل الإدخال البصري.[79]

الذكاء الاجتماعي

[[الحوسبة العاطفية (Affective computing) هي مظلة متعددة التخصصات تضم أنظمة تتعرف على المشاعر وتفسرها وتعالجها أو تحاكيها لدى الإنسان، مثل المزاج والعاطفة.[81]على سبيل المثال، يتم برمجة بعض المساعدين الافتراضيين للتحدث بشكل محادثاتي أو حتى للمزاح بطريقة مضحكة؛ مما يجعلها تبدو أكثر حساسية للديناميات العاطفية للتفاعل الإنساني، أو لتيسير التفاعل بين الإنسان والحاسوب. ومع ذلك، فإن هذا يميل إلى إعطاء المستخدمين الساذجين تصوراً غير واقعي عن مدى ذكاء العوامل الحاسوبية الموجودة بالفعل[82] . وتتضمن النجاحات المتوسطة المتعلقة بالحوسبة العاطفية تحليل المشاعر النصية ومؤخراً تحليل المشاعر متعددة الوسائط، حيث يصنف الذكاء الاصطناعي المشاعر التي يظهرها الشخص في الفيديو.[83]

الذكاء العام

يمكن للآلة ذات الذكاء العام حل مجموعة واسعة من المشاكل بالعرض والمرونة المماثلة لذكاء الإنسان. هناك عدة أفكار منافسة حول كيفية تطوير الذكاء الاصطناعي العام. يؤكد هانز مورافيك ومارڤن منسكي أن العمل في مجالات فردية مختلفة يمكن دمجها في نظام متعدد الوكلاء متطور أو هيكلية إدراكية بذكاء عام.[84]يأمل بيدرو دومينغوس في وجود "خوارزمية رئيسية" بسيطة المفهوم ولكن صعبة من الناحية الحسابية يمكن أن تؤدي إلى الذكاء الاصطناعي العام.[85] كما يعتقد آخرون أن السمات الشبيهة بالإنسان مثل الدماغ الاصطناعي أو [86] أو محاكاة نمو الطفل[س] سيصل يوماً ما إلى نقطة حرجة حيث ينشأ الذكاء العام.

الأدوات

البحث والتحسين

يمكن للذكاء الاصطناعي حل العديد من المشكلات من خلال البحث الذكي في العديد من الحلول المحتملة.[87] مكن تقليل الاستدلال إلى أداء البحث. على سبيل المثال، يمكن رؤية الإثبات المنطقي على أنه البحث عن مسار يؤدي من الافتراضات إلى الاستنتاجات، حيث يتم تطبيق قاعدة الاستدلال في كل خطوة.[88] تقوم خوارزميات التخطيط بالبحث من خلال أشجار الأهداف والأهداف الفرعية، في محاولة لإيجاد مسار إلى الهدف المستهدف، وهو ما يسمى بتحليل الوسائل والأغراض.[89]تستخدم خوارزميات الروبوتات لتحريك الأطراف والتقاط الأشياء البحث المحلي في فضاء التكوين.[90]

البحث الشامل البسيط[91] نادراً ما تكون كافية لمعظم المشكلات الحقيقية: فإن فضاء البحث (عدد الأماكن للبحث) تنمو بسرعة لتصل إلى أعداد هائلة. والنتيجة هي بحث بطيء جداً أو لا يكتمل أبداً. الحل، للعديد من المشكلات، هو استخدام "الخوارزميات اليدوية" أو "قواعد الإبهام" التي تفضل الخيارات التي من المرجح أن تصل إلى الهدف والقيام بذلك في عدد أقل من الخطوات. في بعض منهجيات البحث، يمكن أيضاً للخوارزميات اليدوية أن تخدم لإزالة بعض الخيارات التي لا يرجح أن تؤدي إلى هدف (ما يسمى بـ "تقليم شجرة البحث") تزوّد الخوارزميات اليدوية البرنامج بـ "أفضل تخمين" للمسار الذي يكمن عليه الحل.[92]كما تقيد الخوارزميات اليدوية البحث عن الحلول في عينة أصغر.[93]

ظهر نوع مختلف جداً من البحث عن الحلول الأمثل في الأعوام التسعينات، وهو يستند إلى نظرية الاستمثال الرياضي. للعديد من المسائل، يمكن أن نبدأ البحث باستخدام نوع من التخمين، ثم نقوم بتحسين التخمين تدريجيًا حتى لا يمكن إجراء المزيد من التحسينات. يمكن تصور هذه الخوارزميات على أنها اعتلاء القمة عمياء: نبدأ البحث من نقطة عشوائية على المناظر الطبيعية، ثم نقوم بالتحرك بشكل متقطع أو بخطوات، حتى نصل إلى القمة. تتضمن الخوارزميات الأخرى ذات الصلة الاستمثال العشوائي والبحث الشعاعي والأدلة العليا مثل التقوية المحاكاة.[94] يستخدم التحسيب التطوري نوعاً من بحث الأمثلة. على سبيل المثال، يمكن أن يبدأوا بمجموعة من الكائنات الحية (التخمينات) ثم يسمحون لها بالتحول والتزاوج، ويختارون فقط الأقوى بقاءً في كل جيل (تحسين التخمينات). تتضمن الخوارزميات التطورية الكلاسيكية الخوارزميات الجينية وبرمجة التعبير الجيني والبرمجة الجينية.[95] يمكن أن تتنسق عمليات البحث الموزعة بشكل بديل عن طريق خوارزميات ذكاء السرب. تعد خوارزميات استمثال عناصر السرب (المستوحاة من تجمعات الطيور) وخوارزمية قرية النمل (المستوحاة من مسارات النمل) من بين أشهر خوارزميات السرب المستخدمة في البحث.[96]

المنطق

يستخدم المنطق[97]لتمثيل المعرفة وحل المشكلات، ولكن يمكن تطبيقه على مشكلات أخرى أيضاً. على سبيل المثال، تستخدم خوارزمية Satplan المنطق للتخطيط[98]وبرمجة المنطق الاستقرائي هي طريقة للتعلم.[99] تُستخدم عدة أشكال مختلفة من المنطق في البحث الذكاء الاصطناعي. يتضمن حسبان القضايا[100]توابع الحقيقة مثل "أو" و"ليس". يضيف المنطق من المرتبة الأولى[101]المحددات الكمية والمسندات ويمكنه التعبير عن الحقائق حول الكائنات وخصائصها وعلاقاتها مع بعضها البعض. يسند المنطق الضبابي درجة "حقيقة" (بين 0 و1) للعبارات الغامضة مثل "أليس كبيرة" (أو غنية أو طويلة أو جائعة) والتي هي غير دقيقة لغوياً بما يكفي لتكون صحيحة أو خاطئة تماماً.[102]المنطق الافتراضي والمنطق غير الرتيب والتقليص هي أشكال من المنطق المصممة للمساعدة في الاستدلال الافتراضي ومشكلة التأهيل[58]تم تصميم العديد من تمديدات المنطق للتعامل مع مجالات معرفية محددة، مثل تماثل المنطق[54]حساب الحالة وحساب الحدث وحساب التفاضل والتكامل (لتمثيل الأحداث والوقت);[55] حساب السببية;[56] حساب المعتقد (مراجعة المعتقدات); والمنطق النمطيs.[57]كما صُمم المنطق لنمذجة العبارات المتناقضة أو غير المتسقة التي تنشأ في نظم الوكلاء المتعددة، مثل المنطق غير المتناقض.[103]

الأساليب الاحتمالية للاستدلال غير اليقيني

تتطلب العديد من المشاكل في الذكاء الاصطناعي (بما في ذلك الاستدلال والتخطيط والتعلم والإدراك والروبوتات) أن يعمل العامل بمعلومات ناقصة أو غير مؤكدة. وقد صمم الباحثون في الذكاء الاصطناعي عددًا من الأدوات لحل هذه المشاكل باستخدام أساليب من نظرية الاحتمالات والاقتصاد.[104] والشبكات البايزيةs[105] هي أداة عامة جداً يمكن استخدامها لمختلف المشاكل، بما في ذلك الاستدلال (باستخدام خوارزمية الاستدلال البايزية[ش][107] التعلم (باستخدام خوارزمية تعظيم التوقع),[ص][109] التخطيط (باستخدام شبكة القرار)[110] والإدراك (باستخدام شبكات بايزية ديناميكية).[111]يمكن أيضاً استخدام الخوارزميات الاحتمالية للتصفية والتنبؤ والتمهيد وإيجاد التفسيرات لتيارات البيانات، مما يساعد أنظمة الإدراك على تحليل العمليات التي تحدث مع مرور الوقت (على سبيل المثال نماذج ماركوف الخفية أو مرشحات كالمان).[111]

مفهوم رئيسي من علم الاقتصاد هو "المنفعة"، وهي مقياس لمدى قيمة شيء ما بالنسبة لعامل ذكي. وقد تم تطوير أدوات رياضية دقيقة تحلل كيف يمكن للعامل اتخاذ الخيارات والتخطيط، باستخدام نظرية القرار و[[decision analysis|تحليل القرارات،[112] ونظرية قيمة المعلومات.[113]تشمل هذه الأدوات نماذج مثل عمليات ماركوف باتخاذ القرارات[114] وشبكات القرارات الديناميكية[111] ونظرية الألعاب وتصميم الآلية.[115]

المصنفات وطرق التعلم الإحصائية

يمكن تقسيم أبسط تطبيقات الذكاء الاصطناعي إلى نوعين: المصنفات ("إذا كان لامعاً فهو الماس") والمتحكمات ("إذا كان الماساً فالتقطه"). ومع ذلك، تقوم المتحكمات أيضاً بتصنيف الشروط قبل استنتاج الإجراءات، وبالتالي يشكل التصنيف جزءاً أساسياً من العديد من أنظمة الذكاء الاصطناعي. تعتبر المصنفات توابع تستخدم مطابقة الأنماط لتحديد الأقرب تطابقاً. ويمكن ضبطها وفقاً للأمثلة، مما يجعلها جذابة جداً للاستخدام في الذكاء الاصطناعي. تعرف هذه الأمثلة باسم الملاحظات أو الأنماط. في التعلم الخاضع للإشراف، تنتمي كل نمط إلى تصنيف معين محددة مسبقاً، ويعتبر التصنيف قرار يجب اتخاذه. تُعرف جميع الملاحظات بالاشتراك مع علامات التصنيف الخاصة بها بمجموعة بيانات. عندما يتم استلام ملاحظة جديدة، يتم تصنيف تلك الملاحظة بناءً على الخبرة السابقة.[116]

يمكن تدريب المصنف بطرق مختلفة؛ هناك العديد من النهج الإحصائية وتعلم الآلة. شجرة القرار هي أبسط خوارزمية تعلم رمزية وأكثرها استخداماً.[117]كانت خوارزمية الجوار الأقرب (k-nearest neighbor) أكثر أنظمة الذكاء الاصطناعي القياسية حتى منتصف التسعينات.[118] حلت خوارزمية النوى مثل آلة المتجهات الداعمة (SVM) محل خوارزمية الجوار الأقرب k أقرب جار في التسعينيات.[119]يُقال إن مصنف بايز الساذج هو "أكثر المتعلمين استخداماً[120] في جوجل، ويرجع ذلك جزئياً إلى قابلية التوسع.[121]تستخدم الشبكات العصبية أيضاً للتصنيف.[122]

يتوقف أداء المصنّف بشكل كبير على خصائص البيانات التي يتم تصنيفها، مثل حجم مجموعة البيانات، توزيع العينات عبر التصنيفات، الأبعاد، ومستوى الضوضاء. تؤدي المصنّفات المعتمدة على النموذج بشكل جيد إذا كان النموذج المفترض مطابقاً بشكل مثالي للبيانات الفعلية. في حالة عدم توافر نموذج مطابق وإذا كانت الدقة (وليس السرعة أو التوافق مع المقياس) هي الهدف الأساسي، فمن المعتاد وفقاً للحكمة التقليدية أن المصنّفات التمييزية (خاصة SVM) تميل إلى أن تكون أكثر دقة من المصنّفات المعتمدة على النموذج مثل "البايز الساذج" على معظم مجموعات البيانات العملية.[123]

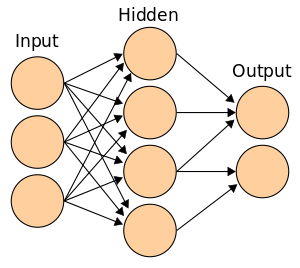

الشبكات العصبية الاصطناعية

استوحيت الشبكات العصبونية[122]من بنية الخلايا العصبية في الدماغ البشري. تقبل العقدة العصبية البسيطة "N" المدخلات من العقد العصبية الأخرى، والتي إذا تم تنشيطها (أو "إطلاقها")، فإنها تصوت "بصوت مرجح" بالنسبة أو ضد ما إذا كان يجب تنشيط العقدة N نفسها. يتطلب التعلم خوارزمية لضبط هذه الأوزان بناءً على بيانات التدريب؛ أحد الخوارزميات البسيطة (الملقبة بـ "fire together, wire together") هو زيادة الوزن بين عقدتين متصلتين عندما يؤدي تنشيط واحد إلى تنشيط ناجح للآخر. تتميز العقد بطيف مستمر من التنشيط؛ بالإضافة إلى ذلك، يمكن للعقد تجهيز المدخلات بطريقة غير خطية بدلاً من وزن التصويت بشكل مباشر.

الشبكات العصبية الحديثة تقوم بنمذجة العلاقات المعقدة بين المدخلات والمخرجات وإيجاد الأنماط في البيانات. يمكن أن تتعلم الشبكات العصبية الدوال المستمرة وحتى العمليات الرقمية المنطقية. يمكن تصور الشبكات العصبية على أنها نوع من رياضيات الاستمثال، حيث يتم تنفيذ الانحدار التدريجي على مضلع متعدد الأبعاد يتم إنشاؤه من خلال تدريب الشبكة. أكثر تقنية تدريب شائعة هي خوارزمية الانتشار الخلفي.[124]وتعد تقنيات التعلم الأخرى للشبكات العصبية مثل التعلم الهيبي، GMDH أو التعلم التنافسي جزءاً من البحث في هذا المجال.[125]

التصنيفات الرئيسية للشبكات العصبية هي الشبكات العصبية المغذاة (feedforward neural networks) حيث تمر الإشارة في اتجاه واحد فقط، والشبكات العصبونية المتكررة (recurrent neural networks) التي تسمح بالردود والذاكرة القصيرة الأجل للأحداث السابقة. ومن بين الشبكات العصبية غير المتداخلة الأكثر شهرة هي البرسبترونات، والپرسپترون متعدد الطبقات والشبكات القطرية الأساسية.[126]

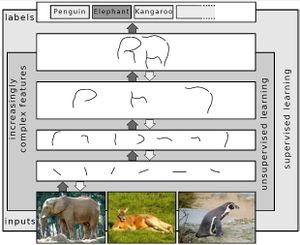

التعلم العميق

التعلم العميق[128] هو مفهوم يستخدم عدة طبقات من العصبونات بين مدخلات الشبكة ومخرجاتها. يمكن للطبقات المتعددة استخراج سمات ذات مستويات أعلى تدريجياً من المدخلات الأولية. على سبيل المثال، في معالجة الصور، يمكن للطبقات الأدنى تحديد الحواف، في حين يمكن للطبقات الأعلى تحديد المفاهيم ذات الصلة بالإنسان مثل الأرقام أو الحروف أو الوجوه[129]. وقد ساهم التعلم العميق بشكل كبير في تحسين أداء البرامج في العديد من الحقول الفرعية الهامة للذكاء الاصطناعي، بما في ذلك الرؤية الحاسوبية والتعرف على الكلام وتصنيف الصور [130] وغيرها.

يستخدم التعلم العميق في كثير من الأحيان الشبكات العصبونية الالتفافية للعديد من طبقاته أو لكل طبقاته. في الطبقة التحويلية، يتلقى كل عصب إشارة فقط من منطقة محددة من الطبقة السابقة تسمى مجال الاستقبال الخاص بالعصب. يمكن أن يقلل هذا بشكل كبير من عدد الاتصالات المرجحة بين الأعصاب[131] ويخلق تسللًًا هرمياً مشابهاً لتنظيم قشرة المخ البصرية في الحيوانات[132]

في الشبكات العصبونية المتكررة يتم تمرير الإشارة من خلال الطبقة أكثر من مرة[133]بالتالي، فإن RNN هو مثال على التعلم العميق.[134] ومع ذلك، يمكن تدريب RNNs التدرجات المنحدرة[135]ومع ذلك، فإن التدريب باستخدام الانحدار اللاتجاهي يمكن أن يؤدي إلى انخفاض تدريجي في بعض الأحيان للمشتقات على المدى الطويل والتي يتم توجيهها إلى الوراء، والتي يمكن أن تتجه نحو الصفر (أي أن تتلاشى) أو الانفجار (أي أن تتجه نحو لانهاية)، وهذا ما يُعرف بمشكلة التدريج المتلاشية.[136]يمكن لذاكرة طويلة المدى (LSTM) منع هذه المشكلة في معظم الحالات.[137]

اللغات والأجهزة المتخصصة

تم تطوير لغات متخصصة للذكاء الاصطناعي، مثل ليسب، برولوج، تنسور فلو وغيرها الكثير. وتشمل الأجهزة التي تم تطويرها للذكاء الاصطناعي AI accelerato وهندسة التشكيل العصبي.

التطبيقات

يعتبر الذكاء الاصطناعي ذو صلة بأي مهمة فكرية.[138] تتفشى تقنيات الذكاء الاصطناعي الحديثة ولا يمكن حصرها بسهولة.[139]وعادة ما يتوقف اعتبار تقنية ما كذلك دورها كذكاء اصطناعي عندما تصبح شائعة بشكل كبير، ويوصف هذه الظاهرة باسم "تأثير الذكاء الاصطناعي".[140]

في العقد الأخير من القرن الحادي والعشرين، كانت تطبيقات الذكاء الاصطناعي هي قلب أكثر المجالات نجاحاً تجارياً في مجال الحوسبة، وأصبحت ميزة شائعة في الحياة اليومية. يتم استخدام الذكاء الاصطناعي في محركات البحث (مثل بحث جوجل) واستهداف الإعلانات عبر الإنترنت،[141]وأنظمة التوصية (التي تقدمها نتفليكس ويوتيوب وأمازون)، وتوجيه حركة الإنترنت[142][143]والإعلان الموجه (أدسنس وفيسبوك)، والمساعدين الافتراضيين (مثل سيري أو ألكسا)[144]، والمركبات الذاتية (بما في ذلك الطائرات بدون طيار وأنظمة مساعدة السائق المتقدمة والسيارات ذاتية القيادة)، والترجمة اللغوية الآلية (مترجم مايكروسوفت وترجمة جوجل)، والتعرف على الوجوه (Face ID من أبل أو DeepFace من مايكروسوفت)، وتسمية الصور (التي يستخدمها فيسبوك وiPhoto من أبل وتيك توك)، وتصفية البريد المزعج وبوتات الدردشة (مثل Chat GPT).

هناك أيضاً آلاف التطبيقات الناجحة للذكاء الاصطناعي التي تستخدم لحل مشاكل محددة في الصناعات أو المؤسسات. ومن أمثلة ذلك تخزين الطاقة، [145] التزييف العميق،[146]وتشخيص الأمراض الطبية، والخدمات اللوجستية العسكرية، السياسات الخارجية[147]أو إدارة سلاسل الإمداد.

اعتبرت لعبة Game playing اختباراً لقوة الذكاء الاصطناعي منذ الخمسينيات. أصبح Deep Blue أول نظام حاسوبي للعب الشطرنج يهزم بطل العالم الحالي للشطرنج، جاري كاسباروف،[148] في 11 مايو 1997. في عام 2011، في مباراة عرضية لبرنامج مسابقات Jeopardy!، تغلب نظام الإجابة على الأسئلة من إنتاج شركة آيبيإم، واتسون، بشكل كبير على أعظم بطلي Jeopardy!، براد روتر وكين جينينغز.[149] في مارس 2016، فازت AlphaGo بأربعة من خمسة مباريات في لعبة Go ضد بطل العالم بلعبة Go، لي سيدول، وأصبح أول نظام لعب الـ Go بالكمبيوتر الذي يهزم لاعباً محترفاً في لعبة Go بدون عوائق.[150] تتعامل برامج أخرى مع الألعاب غير كاملة المعلومات، مثل البوكر على مستوى خارق، مثل Pluribus[ض] وCepheus.[152] طوّرت شركة ديب مايند خلال العقد الأخير من القرن الحادي والعشرين "ذكاءً اصطناعياً عاماً" يمكنه تعلم العديد من ألعاب أتاري المتنوعة بمفرده.

في عام 2020، أصبحت نظم معالجة اللغة الطبيعية مثل GPT-3 الضخمة (والتي كانت حينذاك أكبر شبكة عصبية اصطناعية) تتطابق مع أداء الإنسان على معايير الأداء السابقة، على الرغم من عدم اكتساب النظام فهماً سليماً لمحتويات هذه المعايير بشكل عام.[153]وقد أظهر AlphaFold 2 (2020) التابعة لشركة ديب مايند القدرة على تقريب بنية بروتين ثلاثية الأبعاد في ساعات بدلاً من أشهر.[154] تتنبأ تطبيقات أخرى بنتائج القرارات القضائية،[155] وتخلق فناً (مثل الشعر أو الرسم) وتبرهن النظريات الرياضية.

تستخدم أدوات كشف محتوى الذكاء الاصطناعي هي تطبيقات برامجية خوارزميات الذكاء الاصطناعي لتحليل وكشف أنواع محددة من المحتوى في وسائط الإعلام الرقمية، مثل النصوص والصور والفيديوهات. يتم استخدام هذه الأدوات بشكل شائع لتحديد المحتوى غير الملائم، مثل أخطاء الكلام والصور العنيفة أو الجنسية والبريد العشوائي وغيرها.

تعد بعض المزايا لاستخدام أدوات كشف المحتوى باستخدام الذكاء الاصطناعي[156] تحسين الكفاءة والدقة في الكشف عن المحتوى غير الملائم، زيادة السلامة والأمان للمستخدمين، وتقليل المخاطر القانونية والسمعة للمواقع والمنصات.

إشارات المرور الذكية

تم تطوير إشارات المرور الذكية في جامعة كارنيجي ميلون منذ عام 2009، وبدأ الأستاذ ستيفن سميث شركة تدعى Surtrac منذ ذلك الحين وقامت بتركيب أنظمة تحكم مرور ذكية في 22 مدينة. تبلغ تكلفة التثبيت حوالي 20,000 دولار لكل تقاطع، وقد تم تقليل وقت القيادة بنسبة 25% وتم تقليل وقت انتظار الزحام المروري بنسبة 40% في التقاطعات التي تم تركيبها.[157]

الملكية الفكرية

في عام 2019، ذكرت منظمة الويبو (WIPO) أن الذكاء الاصطناعي كان التكنولوجيا الناشئة الأكثر إنتاجية من حيث عدد طلبات البراءات والبراءات الممنوحة، حيث تم تقدير أن شبكة الأشياء (إنترنت الأشياء) هي الأكبر من حيث حجم السوق. وتلتها، مرة أخرى من حيث حجم السوق، تقنيات البيانات الكبيرة، والروبوتات، والذكاء الاصطناعي، والطباعة ثلاثية الأبعاد، والجيل الخامس من خدمات المحمول (5G).[158] منذ ظهور الذكاء الاصطناعي في الخمسينات، تم تقديم 340,000 طلب براءة اختراع متعلقة بالذكاء الاصطناعي من قبل المبتكرين، وتم نشر 1.6 مليون ورقة بحثية من قبل الباحثين، مع تغلب معظم طلبات البراءات المتعلقة بالذكاء الاصطناعي على النشر منذ عام 2013. تمثل الشركات 26 من أصل 30 متقدمًا لطلبات براءات الاختراع المتعلقة بالذكاء الاصطناعي، في حين تتحمل الجامعات أو المنظمات العامة للبحوث الأربعة المتبقية.[159] لقد انخفضت نسبة الأوراق البحثية إلى الاختراعات بشكل كبير من 8:1 في عام 2010 إلى 3:1 في عام 2016، ويعزى ذلك إلى تحول من البحوث النظرية إلى استخدام تقنيات الذكاء الاصطناعي في المنتجات والخدمات التجارية. تعد تقنية التعلم الآلي هي التقنية السائدة في الاختراعات المتعلقة بالذكاء الاصطناعي وتشمل أكثر من ثلث الاختراعات المحددة (134,777 براءة اختراع لتقنية التعلم الآلي من أصل 167,038 براءة اختراع مقدمة لتقنيات الذكاء الاصطناعي في عام 2016)، ويعد تطبيق الرؤية الحاسوبية هو التطبيق الوظيفي الأكثر شيوعاً. تكشف براءات الاختراع المتعلقة بالذكاء الاصطناعي ليس فقط عن تقنيات الذكاء الاصطناعي وتطبيقاتها، بل غالبًا ما تشير أيضًا إلى مجال التطبيق أو الصناعة. تم تحديد عشرين مجالًا للتطبيق في عام 2016، وشملت على التوالي: الاتصالات (15 في المائة)، والنقل (15 في المائة)، والعلوم الحياتية والطبية (12 في المائة)، والأجهزة الشخصية والحوسبة والتفاعل بين الإنسان والحاسوب (11 في المائة). وتضمنت القطاعات الأخرى البنوك والترفيه والأمن والصناعة والتصنيع والزراعة والشبكات (بما في ذلك الشبكات الاجتماعية والمدن الذكية وإنترنت الأشياء). تمتلك شركة IBM أكبر محفظة براءات اختراع الذكاء الاصطناعي بـ 8,290 تقدماً لبراءات الاختراع، تليها شركة مايكروسوفت مع 5930 طلب براءة اختراع.[159]

الفلسفة

تعريف الذكاء الاصطناعي

كتب ألان تورينغ عام 1950 "أقترح التفكير في السؤال 'هل يمكن للآلات التفكير؟'""[160] ونصح بتغيير السؤال من ما إذا كانت الآلة "تفكر" إلى "ما إذا كان من الممكن للآلات أن تظهر سلوكاً ذكياً".[160] وقد صاغ اختبار تورينغ الذي يقيس قدرة الآلة على محاكاة المحادثة البشرية.[161] ونظراً لأننا يمكننا مراقبة سلوك الآلة فقط، فلا يهم إذا كانت "تفكر" فعلياً أو لديها "عقل" حرفياً. ولاحظ تورينغ أننا لا يمكننا تحديد هذه الأشياء بشأن الأشخاص الآخرين، ولكن "من المعتاد أن يكون لدينا اتفاق مهذب بأن الجميع يفكر".[ط] [162]

يتفق كل من راسل ونورفيغ مع تورينج على أنه يجب تعريف الذكاء الاصطناعي بالنسبة لـ "التصرف" وليس "التفكير".[163]ومع ذلك، فإنهم ينتقدون أن الاختبار يقارن بين الآلات والأشخاص. "نصوص الهندسة الجوية"، كما كتبوا "لا تحدد هدف مجالهم كصنع 'آلات تطير بدقة مثل الحمام حتى يمكنها خداع الحمام الآخر'".'"[164]وافق مؤسس الذكاء الاصطناعي جون ماكارثي، مشيراً إلى أن "الذكاء الاصطناعي بالتعريف ليس محاكاةً للذكاء البشري.[165]

يعرّف مكارثي الذكاء بأنه "الجزء الحسابي من القدرة على تحقيق الأهداف في العالم"."[166]ويعرّف أحد مؤسسي الذكاء الاصطناعي الآخر، مارفن منسكي، الذكاء على نحو مشابه على أنه "القدرة على حل المشاكل الصعبة".[167] تنظر تلك التعريفات إلى الذكاء من خلال المشاكل المحددة بوضوح والحلول المحددة بوضوح أيضاً، حيث تشكل صعوبة المشكلة وأداء البرنامج مقاييس مباشرة لـ "ذكاء" الآلة، ولا يلزم أي مناقشة فلسفية إضافية أو قد لا تكون ممكنة.

تعريف تم اعتماده أيضاً من قبل جوجل[168][مطلوب مصدر أفضل] – تعتبر هذه التعريفات من أهم الممارسات في مجال الذكاء الاصطناعي. حيث يشير هذا التعريف إلى قدرة الأنظمة على توليد المعلومات كمظهر للذكاء، مما يشبه الطريقة التي يتم بها تعريف الذكاء في الحياة الطبيعية.

تقييم مناهج الذكاء الاصطناعي

لا توجد نظرية أو نمط موحّد ومعتمد يوجّه أبحاث الذكاء الاصطناعي بأغلب تاريخه.[ظ] فقد غطّت النجاحات السابقة للتعلّم الإحصائي الآلي في العقد الأول من الألفية الثانية جميع النهج الآخرين (بحيث يستخدم بعض المصادر، وخاصة في العالم الأعمال، مصطلح "الذكاء الاصطناعي" للدلالة على "التعلّم الآلي بالشبكات العصبية"). هذا النهج يعتمد بشكل أساسي على التعلم الإحصائي الآلي ويكون غالباً شبه رمزي ومنظم ولين ومحدود (انظر أدناه). يعتبر النقاد أنه قد يتعيّن إعادة النظر في هذه الأسئلة من قبل الأجيال المستقبلية من الباحثين في مجال الذكاء الاصطناعي.

الذكاء الاصطناعي الرمزي وحدوده

يحاكي الذكاء الاصطناعي الرمزي (أو "GOFAI" الطراز القديم الجيد للذكاء الاصطناعي)[170] التفكير الواعي العالي الذي يستخدمه الأشخاص عند حل الألغاز والتعبير عن المنطق القانوني والقيام بالرياضيات. كانت هذه الأنظمة ناجحة للغاية في المهام "الذكية" مثل الجبر أو اختبارات الذكاء. في الستينيات، اقترح نيويل وسيمون فرضية أنظمة الرمز الفعلي: "لنظام رمز فعلي وسيلة ضرورية وكافية للعمل الذكي العام".[171] ومع ذلك، فشل النهج الرمزي في العديد من المهام التي يحلها البشر بسهولة، مثل التعلم والتعرف على الأشياء والاستدلال الشائع. إن مفارقة مورافيك هي اكتشاف أن المهام "الذكية" على مستوى عالٍ كانت سهلة بالنسبة للذكاء الاصطناعي، ولكن المهام "الغريزية" على مستوى منخفض كانت صعبة للغاية.[172]وقد جادل الفيلسوف هوبرت دريفوس منذ الستينيات بأن الخبرة البشرية تعتمد على الغريزة اللاواعية بدلاً من التلاعب بالرموز الواعية، وعلى امتلاك "شعور" بالوضع بدلاً من المعرفة الرمزية الصريحة.[173] وعلى الرغم من سخرية وتجاهل حججه عندما قدمت للمرة الأولى، وأخيراً وافق البحث في مجال الذكاء الاصطناعي على هذه الحجج.[ع][51]

لم يتم حل المسألة: يمكن للاستدلال الفرعي الرمزي أن يرتكب العديد من الأخطاء التي لا يمكن فهمها بنفس الطريقة التي يفعل بها الحدس البشري، مثل التحيز الحسابي. يقول النقاد مثل نعوم تشومسكي إن البحث المستمر في الذكاء الاصطناعي الرمزي سيظل ضرورياً لتحقيق الذكاء العام [175][176] جزئياً لأن الذكاء الاصطناعي الفرعي الرمزي هو خطوة بعيداً عن الذكاء الاصطناعي القابل للتفسير: يمكن أن يكون من الصعب أو المستحيل فهم سبب اتخاذ برنامج الذكاء الاصطناعي الإحصائي الحديث لقرار معين. يحاول مجال الذكاء الاصطناعي العصبي الرمزي الناشئ تقريب المنهجين المختلفين.

Neat vs. scruffy

يصف أسلوب نيتس Neats وصف السلوك الذكي باستخدام مبادئ بسيطة وأنيقة (مثل المنطق أو الأمثَلة أو [[شبكات عصبونية|الشبكات العصبية). أما Scruffies "سكرافيز" فهو يتطلب حلاً لعدد كبير من المشاكل غير المتعلقة (خاصةً في مجالات مثل الاستدلال المنطقي البديهي). تم مناقشة هذه المسألة بنشاط في السبعينيات والثمانينيات[177]ولكن في التسعينيات أصبحت الأساليب الرياضية والمعايير العلمية الصلبة الأسلوب الأساسي، وهو ما وصفه راسل ونورفيج بـ "انتصار نيتس.[178]

الحوسبة اللينة مقابل الصلبة

إيجاد حل صحيح أو أمثل للمسائل الهامة بالنسبة للعديد من المسائل هو أمر مستعصي الحل.[50]الحوسبة اللينة هي مجموعة من التقنيات، بما في ذلك الخوارزميات الجينية والمنطق الضبابي والشبكات العصبية، التي تتحمل عدم الدقة والغموض والحقائق الجزئية والتقريب. تم تقديم الحوسبة اللينة في أواخر الثمانينيات ومعظم البرامج الناجحة في الذكاء الاصطناعي في القرن الحادي والعشرين هي أمثلة على الحوسبة اللينة بالشبكات العصبية.

الذكاء الاصطناعي العام مقابل المحدود

تختلف آراء الباحثين في مجال الذكاء الاصطناعي حول ما إذا كان يجب متابعة أهداف الذكاء الاصطناعي العام والفائق (الذكاء العام) مباشرةً، أم حل أكبر قدر ممكن من المشكلات النوعية (الذكاء الضيق) على أمل أن تؤدي هذه الحلول بشكل غير مباشر إلى أهداف المجال على المدى الطويل.[179][180] يعد الذكاء العام صعب التعريف وصعب القياس، ولقد حقق الذكاء الاصطناعي الحديث المزيد من النجاحات القابلة للتحقق من خلال التركيز على مشكلات محددة ذات حلول محددة. يدرس المجال التجريبي للذكاء العام هذا المجال بصفة حصرية.

الوعي الآلي، الإحساس والفكر

لا تعرف فلسفة العقل إذا كان يمكن للآلة أن تمتلك عقلاً، ووعياً، وحالات عقلية، بنفس المعنى الذي يمتلكه البشر. ينظر الباحثون في الذكاء الاصطناعي الرئيسيون إلى هذه المسألة على أنها لا تهمهم لأنها لا تؤثر على أهداف المجال. يلاحظ ستيوارت راسل وبيتر نورفيغ أن معظم باحثي الذكاء الاصطناعي "لا يهتمون بـ [فلسفة الذكاء الاصطناعي] - طالما أن البرنامج يعمل، فهم لا يهتمون ما إذا كنت تسميه محاكاة للذكاء أو ذكاء حقيقي".[181] ومع ذلك، أصبح السؤال محورياً في فلسفة العقل. كما أنه عادةً ما يكون السؤال المركزي في الذكاء الاصطناعي في الخيال العلمي.

الوعي

حدد ديفد تشالمرز مشكلتين في فهم العقل،[182] وأطلق عليهما اسم "المشكلة الصعبة" و"المشكلة السهلة" في الوعي. المشكلة السهلة هي فهم كيفية معالجة الدماغ للإشارات، وصنع الخطط والتحكم في السلوك. المشكلة الصعبة هي تفسير كيف يشعر الإنسان بالأمر، أو لماذا يجب أن يشعر بأي شيء على الإطلاق. إن معالجة المعلومات البشرية سهلة التفسير، ومع ذلك فإن التجربة الشخصية للإنسان تبقى صعبة التفسير. على سبيل المثال، فمن السهل تخيل شخصاً يعاني من عمى الألوان ولكنه تعلم كيفية تحديد الأشياء الحمراء في مجال رؤيته، ولكن من غير واضح ما الذي يلزم للشخص لمعرفة ما هو اللون الأحمر بالفعل.[183]

الحوسبية والوظائفية

الحوسبية هي الموقف الفلسفي الذي يعتبر فيه العقل البشري نظام معالجة للمعلومات وأن التفكير هو شكل من أشكال الحوسبة. يؤكد المدرسون الحوسبيون أن العلاقة بين العقل والجسد مشابهة أو مطابقة للعلاقة بين البرمجيات والأجهزة الأساسية، وبالتالي يمكن أن تكون حلاً لمشكلة الجسد والعقل. وقد استوحي هذا الموقف الفلسفي من عمل الباحثين في مجال الذكاء الاصطناعي وعلماء الإدراك في الستينيات من القرن الماضي، وكان مقترحاً في الأصل من قبل الفلاسفة جيري فودور وهيلاري بوتنام.[184]

وصف الفيلسوف جون سرل هذا الموقف بـ "الذكاء الاصطناعي القوي": "الحاسوب المبرمج بشكل صحيح مع المدخلات والمخرجات المناسبة سيكون لديه عقل بالمعنى الحقيقي نفسه الذي لديه البشر"."[غ]وقد تعارض سرل مع هذا الادعاء بحجته "غرفة اللغة الصينية"، التي تحاول إظهار أنه ولو قامت الآلة بمحاكاة سلوك الإنسان بشكل مثالي، فلا يوجد سبب للافتراض أن لديها عقل أيضاً.[187]

حقوق الروبوت

إذا امتلكت الآلة عقلاً وتجربة ذاتية، فقد يكون لديها أيضاً الوعي (القدرة على الإحساس)، وإذا كان الأمر كذلك، فقد تعاني، وبالتالي فإنها ستكون مستحقة لبعض الحقوق.[188]قد تكون حقوق الروبوتات الافتراضية في طيف من حقوق الحيوانات وحقوق الإنسان. [189] تمت دراسة هذه المسألة في الخيال الأدبي لقرون عديدة[190]، ويتم الآن دراستها من قبل معهد كاليفورنيا للمستقبل، على سبيل المثال. ومع ذلك، يعتبر النقاد بأن المناقشة سابقة لأوانها.[191]

المستقبل

الذكاء الفائق

A superintelligence, hyperintelligence, or superhuman intelligence, is a hypothetical agent that would possess intelligence far surpassing that of the brightest and most gifted human mind. Superintelligence may also refer to the form or degree of intelligence possessed by such an agent.[180]

If research into artificial general intelligence produced sufficiently intelligent software, it might be able to reprogram and improve itself. The improved software would be even better at improving itself, leading to recursive self-improvement.[192] Its intelligence would increase exponentially in an intelligence explosion and could dramatically surpass humans. Science fiction writer Vernor Vinge named this scenario the "singularity".[193] Because it is difficult or impossible to know the limits of intelligence or the capabilities of superintelligent machines, the technological singularity is an occurrence beyond which events are unpredictable or even unfathomable.[194]

Robot designer Hans Moravec, cyberneticist Kevin Warwick, and inventor Ray Kurzweil have predicted that humans and machines will merge in the future into cyborgs that are more capable and powerful than either. This idea, called transhumanism, has roots in Aldous Huxley and Robert Ettinger.[195]

Edward Fredkin argues that "artificial intelligence is the next stage in evolution", an idea first proposed by Samuel Butler's "Darwin among the Machines" as far back as 1863, and expanded upon by George Dyson in his book of the same name in 1998.[196]

Risks

Technological unemployment

In the past, technology has tended to increase rather than reduce total employment, but economists acknowledge that "we're in uncharted territory" with AI.[197] A survey of economists showed disagreement about whether the increasing use of robots and AI will cause a substantial increase in long-term unemployment, but they generally agree that it could be a net benefit if productivity gains are redistributed.[198] Subjective estimates of the risk vary widely; for example, Michael Osborne and Carl Benedikt Frey estimate 47% of U.S. jobs are at "high risk" of potential automation, while an OECD report classifies only 9% of U.S. jobs as "high risk".[ف][200]

Unlike previous waves of automation, many middle-class jobs may be eliminated by artificial intelligence; The Economist states that "the worry that AI could do to white-collar jobs what steam power did to blue-collar ones during the Industrial Revolution" is "worth taking seriously".[201] Jobs at extreme risk range from paralegals to fast food cooks, while job demand is likely to increase for care-related professions ranging from personal healthcare to the clergy.[202]

Bad actors and weaponized AI

AI provides a number of tools that are particularly useful for authoritarian governments: smart spyware, face recognition and voice recognition allow widespread surveillance; such surveillance allows machine learning to classify potential enemies of the state and can prevent them from hiding; recommendation systems can precisely target propaganda and misinformation for maximum effect; deepfakes aid in producing misinformation; advanced AI can make centralized decision making more competitive with liberal and decentralized systems such as markets.[203]

Terrorists, criminals and rogue states may use other forms of weaponized AI such as advanced digital warfare and lethal autonomous weapons. By 2015, over fifty countries were reported to be researching battlefield robots.[204]

Machine-learning AI is also able to design tens of thousands of toxic molecules in a matter of hours.[205]

Algorithmic bias

AI programs can become biased after learning from real-world data. It is not typically introduced by the system designers but is learned by the program, and thus the programmers are often unaware that the bias exists.[206] Bias can be inadvertently introduced by the way training data is selected.[207] It can also emerge from correlations: AI is used to classify individuals into groups and then make predictions assuming that the individual will resemble other members of the group. In some cases, this assumption may be unfair.[208] An example of this is COMPAS, a commercial program widely used by U.S. courts to assess the likelihood of a defendant becoming a recidivist. ProPublica claims that the COMPAS-assigned recidivism risk level of black defendants is far more likely to be overestimated than that of white defendants, despite the fact that the program was not told the races of the defendants.[209]

Health equity issues may also be exacerbated when many-to-many mapping are done without taking steps to ensure equity for populations at risk for bias. At this time equity-focused tools and regulations are not in place to ensure equity application representation and usage.[210] Other examples where algorithmic bias can lead to unfair outcomes are when AI is used for credit rating or hiring.

At its 2022 Conference on Fairness, Accountability, and Transparency (ACM FAccT 2022) the Association for Computing Machinery, in Seoul, South Korea, presented and published findings recommending that until AI and robotics systems are demonstrated to be free of bias mistakes, they are unsafe and the use of self-learning neural networks trained on vast, unregulated sources of flawed internet data should be curtailed.[211]

Existential risk

Superintelligent AI may be able to improve itself to the point that humans could not control it. This could, as physicist Stephen Hawking puts it, "spell the end of the human race".[212] Philosopher Nick Bostrom argues that sufficiently intelligent AI, if it chooses actions based on achieving some goal, will exhibit convergent behavior such as acquiring resources or protecting itself from being shut down. If this AI's goals do not fully reflect humanity's, it might need to harm humanity to acquire more resources or prevent itself from being shut down, ultimately to better achieve its goal. He concludes that AI poses a risk to mankind, however humble or "friendly" its stated goals might be.[213] Political scientist Charles T. Rubin argues that "any sufficiently advanced benevolence may be indistinguishable from malevolence." Humans should not assume machines or robots would treat us favorably because there is no a priori reason to believe that they would share our system of morality.[214]

The opinion of experts and industry insiders is mixed, with sizable fractions both concerned and unconcerned by risk from eventual superhumanly-capable AI.[215] Stephen Hawking, Microsoft founder Bill Gates, history professor Yuval Noah Harari, and SpaceX founder Elon Musk have all expressed serious misgivings about the future of AI.[216] Prominent tech titans including Peter Thiel (Amazon Web Services) and Musk have committed more than $1 billion to nonprofit companies that champion responsible AI development, such as OpenAI and the Future of Life Institute.[217] Mark Zuckerberg (CEO, Facebook) has said that artificial intelligence is helpful in its current form and will continue to assist humans.[218] Other experts argue is that the risks are far enough in the future to not be worth researching, or that humans will be valuable from the perspective of a superintelligent machine.[219] Rodney Brooks, in particular, has said that "malevolent" AI is still centuries away.[ق]

Copyright

AI's decisions making abilities raises the questions of legal responsibility and copyright status of created works. This issues are being refined in various jurisdictions.[221] However, criticism has been raised about whether and to what extent the works created with the assistance of AI are under the protection of copyright laws.[222]

Ethical machines

Friendly AI are machines that have been designed from the beginning to minimize risks and to make choices that benefit humans. Eliezer Yudkowsky, who coined the term, argues that developing friendly AI should be a higher research priority: it may require a large investment and it must be completed before AI becomes an existential risk.[223]

Machines with intelligence have the potential to use their intelligence to make ethical decisions. The field of machine ethics provides machines with ethical principles and procedures for resolving ethical dilemmas.[224] Machine ethics is also called machine morality, computational ethics or computational morality,[224] and was founded at an AAAI symposium in 2005.[225]

Other approaches include Wendell Wallach's "artificial moral agents"[226] and Stuart J. Russell's three principles for developing provably beneficial machines.[227]

Regulation

The regulation of artificial intelligence is the development of public sector policies and laws for promoting and regulating artificial intelligence (AI); it is therefore related to the broader regulation of algorithms.[228] The regulatory and policy landscape for AI is an emerging issue in jurisdictions globally.[229] Between 2016 and 2020, more than 30 countries adopted dedicated strategies for AI.[45] Most EU member states had released national AI strategies, as had Canada, China, India, Japan, Mauritius, the Russian Federation, Saudi Arabia, United Arab Emirates, US and Vietnam. Others were in the process of elaborating their own AI strategy, including Bangladesh, Malaysia and Tunisia.[45] The Global Partnership on Artificial Intelligence was launched in June 2020, stating a need for AI to be developed in accordance with human rights and democratic values, to ensure public confidence and trust in the technology.[45] Henry Kissinger, Eric Schmidt, and Daniel Huttenlocher published a joint statement in November 2021 calling for a government commission to regulate AI.[230]

In fiction

Thought-capable artificial beings have appeared as storytelling devices since antiquity,[16] and have been a persistent theme in science fiction.[18]

A common trope in these works began with Mary Shelley's Frankenstein, where a human creation becomes a threat to its masters. This includes such works as Arthur C. Clarke's and Stanley Kubrick's 2001: A Space Odyssey (both 1968), with HAL 9000, the murderous computer in charge of the Discovery One spaceship, as well as The Terminator (1984) and The Matrix (1999). In contrast, the rare loyal robots such as Gort from The Day the Earth Stood Still (1951) and Bishop from Aliens (1986) are less prominent in popular culture.[231]

Isaac Asimov introduced the Three Laws of Robotics in many books and stories, most notably the "Multivac" series about a super-intelligent computer of the same name. Asimov's laws are often brought up during lay discussions of machine ethics;[232] while almost all artificial intelligence researchers are familiar with Asimov's laws through popular culture, they generally consider the laws useless for many reasons, one of which is their ambiguity.[233]

Transhumanism (the merging of humans and machines) is explored in the manga Ghost in the Shell and the science-fiction series Dune.

Several works use AI to force us to confront the fundamental question of what makes us human, showing us artificial beings that have the ability to feel, and thus to suffer. This appears in Karel Čapek's R.U.R., the films A.I. Artificial Intelligence and Ex Machina, as well as the novel Do Androids Dream of Electric Sheep?, by Philip K. Dick. Dick considers the idea that our understanding of human subjectivity is altered by technology created with artificial intelligence.[234]

انظر أيضاً

- AI safety

- AI alignment

- Artificial intelligence in healthcare – Machine-learning algorithms and software in the analysis, presentation, and comprehension of complex medical and health care data

- Artificial intelligence arms race

- Behavior selection algorithm

- Business process automation

- Case-based reasoning

- Emergent algorithm

- Female gendering of AI technologies

- Glossary of artificial intelligence

- Operations research

- Robotic process automation

- Synthetic intelligence

- Universal basic income

- Weak artificial intelligence

- Data sources – The list of data sources for study and research

Explanatory notes

- ^ أ ب This list of intelligent traits is based on the topics covered by the major AI textbooks, including: Russell & Norvig (2003), Luger & Stubblefield (2004), Poole, Mackworth & Goebel (1998) and Nilsson (1998)

- ^ This statement comes from the proposal for the Dartmouth workshop of 1956, which reads: "Every aspect of learning or any other feature of intelligence can be so precisely described that a machine can be made to simulate it."[11]

- ^ Russel and Norvig note in the textbook Artificial Intelligence: A Modern Approach (4th ed.), section 1.5: "In the longer term, we face the difficult problem of controlling superintelligent AI systems that may evolve in unpredictable ways." while referring to computer scientists, philosophers, and technologists.

- ^ Daniel Crevier wrote "the conference is generally recognized as the official birthdate of the new science."[24] Russell and Norvifg call the conference "the birth of artificial intelligence."[25]

- ^ Russell and Norvig wrote "for the next 20 years the field would be dominated by these people and their students."[25]

- ^ Russell and Norvig wrote "it was astonishing whenever a computer did anything kind of smartish".[27]

- ^ The programs described are Arthur Samuel's checkers program for the IBM 701, Daniel Bobrow's STUDENT, Newell and Simon's Logic Theorist and Terry Winograd's SHRDLU.

- ^ Embodied approaches to AI[37] were championed by Hans Moravec[38] and Rodney Brooks[39] and went by many names: Nouvelle AI,[39] Developmental robotics,[40] situated AI, behavior-based AI as well as others. A similar movement in cognitive science was the embodied mind thesis.

- ^ Clark wrote: "After a half-decade of quiet breakthroughs in artificial intelligence, 2015 has been a landmark year. Computers are smarter and learning faster than ever."[8]

- ^ Alan Turing discussed the centrality of learning as early as 1950, in his classic paper "Computing Machinery and Intelligence".[65] In 1956, at the original Dartmouth AI summer conference, Ray Solomonoff wrote a report on unsupervised probabilistic machine learning: "An Inductive Inference Machine".[66]

- ^ This is a form of Tom Mitchell's widely quoted definition of machine learning: "A computer program is set to learn from an experience E with respect to some task T and some performance measure P if its performance on T as measured by P improves with experience E."[67]

- ^ Alan Turing suggested in "Computing Machinery and Intelligence" that a "thinking machine" would need to be educated like a child.[65] Developmental robotics is a modern version of the idea.[40]

- ^ Compared with symbolic logic, formal Bayesian inference is computationally expensive. For inference to be tractable, most observations must be conditionally independent of one another. AdSense uses a Bayesian network with over 300 million edges to learn which ads to serve.[106]

- ^ Expectation-maximization, one of the most popular algorithms in machine learning, allows clustering in the presence of unknown latent variables.[108]

- ^ The Smithsonian reports: "Pluribus has bested poker pros in a series of six-player no-limit Texas Hold'em games, reaching a milestone in artificial intelligence research. It is the first bot to beat humans in a complex multiplayer competition."[151]

- ^ See Problem of other minds

- ^ Nils Nilsson wrote in 1983: "Simply put, there is wide disagreement in the field about what AI is all about."[169]

- ^ Daniel Crevier wrote that "time has proven the accuracy and perceptiveness of some of Dreyfus's comments. Had he formulated them less aggressively, constructive actions they suggested might have been taken much earlier."[174]

- ^ Searle presented this definition of "Strong AI" in 1999.[185] Searle's original formulation was "The appropriately programmed computer really is a mind, in the sense that computers given the right programs can be literally said to understand and have other cognitive states."[186] Strong AI is defined similarly by Russell and Norvig: "The assertion that machines could possibly act intelligently (or, perhaps better, act as if they were intelligent) is called the 'weak AI' hypothesis by philosophers, and the assertion that machines that do so are actually thinking (as opposed to simulating thinking) is called the 'strong AI' hypothesis."[181]

- ^ See table 4; 9% is both the OECD average and the US average.[199]

- ^ Rodney Brooks writes, "I think it is a mistake to be worrying about us developing malevolent AI anytime in the next few hundred years. I think the worry stems from a fundamental error in not distinguishing the difference between the very real recent advances in a particular aspect of AI and the enormity and complexity of building sentient volitional intelligence."[220]

References

- ^ Google (2016).

- ^ McCorduck (2004), p. 204.

- ^ Schank (1991), p. 38.

- ^ Crevier (1993), p. 109.

- ^ أ ب ت

Funding initiatives in the early 80s: Fifth Generation Project (Japan), Alvey (UK), Microelectronics and Computer Technology Corporation (US), Strategic Computing Initiative (US):

- McCorduck (2004, pp. 426–441)

- Crevier (1993, pp. 161–162,197–203, 211, 240)

- Russell & Norvig (2003, p. 24)

- NRC (1999, pp. 210–211)

- Newquist (1994, pp. 235–248)

- ^ أ ب

First AI Winter, Lighthill report, Mansfield Amendment

- Crevier (1993, pp. 115–117)

- Russell & Norvig (2003, p. 22)

- NRC (1999, pp. 212–213)

- Howe (1994)

- Newquist (1994, pp. 189–201)

- ^ أ ب

Second AI Winter:

- McCorduck (2004, pp. 430–435)

- Crevier (1993, pp. 209–210)

- NRC (1999, pp. 214–216)

- Newquist (1994, pp. 301–318)

- ^ أ ب ت ث Clark (2015b).

- ^ أ ب

AI widely used in late 1990s:

- Russell & Norvig (2003, p. 28)

- Kurzweil (2005, p. 265)

- NRC (1999, pp. 216–222)

- Newquist (1994, pp. 189–201)

- ^ أ ب Pennachin & Goertzel (2007); Roberts (2016)

- ^ McCarthy et al. (1955).

- ^ Newquist (1994), pp. 45–53.

- ^ "s AI Overhyped in 2022? Getting the Truth About the True Power". Analytics Insight. 21 March 2022. Archived from the original on 10 March 2023. Retrieved 11 March 2023.

- ^ Giles, Martin (13 September 2018). "Artificial intelligence is often overhyped—and here's why that's dangerous". MIT Technology. Archived from the original on 11 March 2023. Retrieved 11 March 2023.

- ^ Basen, Ira (21 February 2020). "Is AI overhyped? Researchers weigh in on technology's promise and problems". Canadian Broadcasting Corporation. Archived from the original on 11 March 2023. Retrieved 11 March 2023.

- ^ أ ب

AI in myth:

- McCorduck (2004, pp. 4–5)

- Russell & Norvig (2003, p. 939)

- ^ McCorduck (2004), pp. 17–25.

- ^ أ ب McCorduck (2004), pp. 340–400.

- ^ Berlinski (2000).

- ^

AI's immediate precursors:

- McCorduck (2004, pp. 51–107)

- Crevier (1993, pp. 27–32)

- Russell & Norvig (2003, pp. 15, 940)

- Moravec (1988, p. 3)

- ^ Russell & Norvig (2009), p. 16.

- ^ Manyika 2022, p. 9.

- ^ Manyika 2022, p. 10.

- ^ Crevier (1993), pp. 47–49.

- ^ أ ب Russell & Norvig (2003), p. 17.

- ^

Dartmouth workshop:

- Russell & Norvig (2003, p. 17)

- McCorduck (2004, pp. 111–136)

- NRC (1999, pp. 200–201)

- ^ Russell & Norvig (2003), p. 18.

- ^

Successful Symbolic AI programs:

- McCorduck (2004, pp. 243–252)

- Crevier (1993, pp. 52–107)

- Moravec (1988, p. 9)

- Russell & Norvig (2003, pp. 18–21)

- ^

AI heavily funded in 1960s:

- McCorduck (2004, p. 131)

- Crevier (1993, pp. 51, 64–65)

- NRC (1999, pp. 204–205)

- ^ Howe (1994).

- ^ أ ب Newquist (1994), pp. 86–86.

- ^ Simon (1965, p. 96) quoted in Crevier (1993, p. 109)

- ^ Minsky (1967, p. 2) quoted in Crevier (1993, p. 109)

- ^ Lighthill (1973).

- ^

Expert systems:

- Russell & Norvig (2003, pp. 22–24)

- Luger & Stubblefield (2004, pp. 227–331)

- Nilsson (1998, chpt. 17.4)

- McCorduck (2004, pp. 327–335, 434–435)

- Crevier (1993, pp. 145–62, 197–203)

- Newquist (1994, pp. 155–183)

- ^ Nilsson (1998), p. 7.

- ^ McCorduck (2004), pp. 454–462.

- ^ Moravec (1988).

- ^ أ ب Brooks (1990).

- ^ أ ب Developmental robotics:

- ^

Revival of connectionism:

- Crevier (1993, pp. 214–215)

- Russell & Norvig (2003, p. 25)

- ^

Formal and narrow methods adopted in the 1990s:

- Russell & Norvig (2003, pp. 25–26)

- McCorduck (2004, pp. 486–487)

- ^ McKinsey (2018).

- ^ MIT Sloan Management Review (2018); Lorica (2017)

- ^ أ ب ت ث UNESCO (2021).

- ^ Lanier, Jaron (April 20, 2023). "Annals of Artificial Intelligence - There Is No A.I. - There are ways of controlling the new technology—but first we have to stop mythologizing it". The New Yorker. Archived from the original on April 23, 2023. Retrieved April 24, 2023.

- ^ Bogdan, Dennis (February 2, 2023). "Comment - In the Age of A.I., Major in Being Human - David Brooks". The New York Times. Archived from the original on February 3, 2023. Retrieved April 24, 2023.

- ^

Problem solving, puzzle solving, game playing and deduction:

- Russell & Norvig (2003, chpt. 3–9)

- Poole, Mackworth & Goebel (1998, chpt. 2,3,7,9)

- Luger & Stubblefield (2004, chpt. 3,4,6,8)

- Nilsson (1998, chpt. 7–12)

- ^

Uncertain reasoning:

- Russell & Norvig (2003, pp. 452–644)

- Poole, Mackworth & Goebel (1998, pp. 345–395)

- Luger & Stubblefield (2004, pp. 333–381)

- Nilsson (1998, chpt. 19)

- ^ أ ب ت

Intractability and efficiency and the combinatorial explosion:

- Russell & Norvig (2003, pp. 9, 21–22)

- ^ أ ب ت Psychological evidence of the prevalence sub-symbolic reasoning and knowledge:

- ^

Knowledge representation and knowledge engineering:

- Russell & Norvig (2003, pp. 260–266, 320–363)

- Poole, Mackworth & Goebel (1998, pp. 23–46, 69–81, 169–233, 235–277, 281–298, 319–345)

- Luger & Stubblefield (2004, pp. 227–243),

- Nilsson (1998, chpt. 17.1–17.4, 18)

- ^ Russell & Norvig (2003), pp. 320–328.

- ^ أ ب ت

Representing categories and relations: Semantic networks, description logics, inheritance (including frames and scripts):

- Russell & Norvig (2003, pp. 349–354),

- Poole, Mackworth & Goebel (1998, pp. 174–177),

- Luger & Stubblefield (2004, pp. 248–258),

- Nilsson (1998, chpt. 18.3)

- ^ أ ب Representing events and time:Situation calculus, event calculus, fluent calculus (including solving the frame problem):

- Russell & Norvig (2003, pp. 328–341),

- Poole, Mackworth & Goebel (1998, pp. 281–298),

- Nilsson (1998, chpt. 18.2)

- ^ أ ب

Causal calculus:

- Poole, Mackworth & Goebel (1998, pp. 335–337)

- ^ أ ب

Representing knowledge about knowledge: Belief calculus, modal logics:

- Russell & Norvig (2003, pp. 341–344),

- Poole, Mackworth & Goebel (1998, pp. 275–277)

- ^ أ ب

Default reasoning, Frame problem, default logic, non-monotonic logics, circumscription, closed world assumption, abduction:

- Russell & Norvig (2003, pp. 354–360)

- Poole, Mackworth & Goebel (1998, pp. 248–256, 323–335)

- Luger & Stubblefield (2004, pp. 335–363)

- Nilsson (1998, ~18.3.3)

- ^ أ ب

Breadth of commonsense knowledge:

- Russell & Norvig (2003, p. 21),

- Crevier (1993, pp. 113–114),

- Moravec (1988, p. 13),

- Lenat & Guha (1989, Introduction)

- ^ Smoliar & Zhang (1994).

- ^ Neumann & Möller (2008).

- ^ Kuperman, Reichley & Bailey (2006).

- ^ McGarry (2005).

- ^ Bertini, Del Bimbo & Torniai (2006).

- ^ أ ب Turing (1950).

- ^ Solomonoff (1956).

- ^ Russell & Norvig (2003), pp. 649–788.

- ^

Learning:

- Russell & Norvig (2003, pp. 649–788)

- Poole, Mackworth & Goebel (1998, pp. 397–438)

- Luger & Stubblefield (2004, pp. 385–542)

- Nilsson (1998, chpt. 3.3, 10.3, 17.5, 20)

- ^

Reinforcement learning:

- Russell & Norvig (2003, pp. 763–788)

- Luger & Stubblefield (2004, pp. 442–449)

- ^ The Economist (2016).

- ^ Jordan & Mitchell (2015).

- ^

Natural language processing (NLP):

- Russell & Norvig (2003, pp. 790–831)

- Poole, Mackworth & Goebel (1998, pp. 91–104)

- Luger & Stubblefield (2004, pp. 591–632)

- ^

Applications of NLP:

- Russell & Norvig (2003, pp. 840–857)

- Luger & Stubblefield (2004, pp. 623–630)

- ^ Modern statistical approaches to NLP:

- ^ Vincent (2019).

- ^

Machine perception:

- Russell & Norvig (2003, pp. 537–581, 863–898)

- Nilsson (1998, ~chpt. 6)

- ^

Speech recognition:

- Russell & Norvig (2003, pp. 568–578)

- ^

Object recognition:

- Russell & Norvig (2003, pp. 885–892)

- ^

Computer vision:

- Russell & Norvig (2003, pp. 863–898)

- Nilsson (1998, chpt. 6)

- ^ MIT AIL (2014).

- ^ Affective computing:

- ^ Waddell (2018).

- ^ Poria et al. (2017).

- ^

The Society of Mind:

Moravec's "golden spike":

- Moravec (1988, p. 20)

- Russell & Norvig (2003, pp. 27, 932, 970–972)

- Nilsson (1998, chpt. 25)

- ^ Domingos (2015), Chpt. 9.

- ^

Artificial brain as an approach to AGI:

- Russell & Norvig (2003, p. 957)

- Crevier (1993, pp. 271 & 279)

- Goertzel et al. (2010)

- Moravec (1988, p. 20)

- Kurzweil (2005, p. 262)

- Hawkins & Blakeslee (2005)

- ^

Search algorithms:

- Russell & Norvig (2003, pp. 59–189)

- Poole, Mackworth & Goebel (1998, pp. 113–163)

- Luger & Stubblefield (2004, pp. 79–164, 193–219)

- Nilsson (1998, chpt. 7–12)

- ^ Forward chaining, backward chaining, Horn clauses, and logical deduction as search:

- Russell & Norvig (2003, pp. 217–225, 280–294)

- Poole, Mackworth & Goebel (1998, pp. ~46–52)

- Luger & Stubblefield (2004, pp. 62–73)

- Nilsson (1998, chpt. 4.2, 7.2)

- ^

State space search and planning:

- Russell & Norvig (2003, pp. 382–387)

- Poole, Mackworth & Goebel (1998, pp. 298–305)

- Nilsson (1998, chpt. 10.1–2)

- ^ Moving and configuration space:

- Russell & Norvig (2003, pp. 916–932)

- ^ Uninformed searches (breadth first search, depth-first search and general state space search):

- Russell & Norvig (2003, pp. 59–93)

- Poole, Mackworth & Goebel (1998, pp. 113–132)

- Luger & Stubblefield (2004, pp. 79–121)

- Nilsson (1998, chpt. 8)

- ^

Heuristic or informed searches (e.g., greedy best first and A*):

- Russell & Norvig (2003, pp. 94–109)

- Poole, Mackworth & Goebel (1998, pp. pp. 132–147)

- Poole & Mackworth (2017, Section 3.6)

- Luger & Stubblefield (2004, pp. 133–150)

- ^ Tecuci (2012).

- ^ Optimization searches:

- Russell & Norvig (2003, pp. 110–116,120–129)

- Poole, Mackworth & Goebel (1998, pp. 56–163)

- Luger & Stubblefield (2004, pp. 127–133)

- ^

Genetic programming and genetic algorithms:

- Luger & Stubblefield (2004, pp. 509–530)

- Nilsson (1998, chpt. 4.2)

- ^

Artificial life and society based learning:

- Luger & Stubblefield (2004, pp. 530–541)

- Merkle & Middendorf (2013)

- ^

Logic:

- Russell & Norvig (2003, pp. 194–310),

- Luger & Stubblefield (2004, pp. 35–77),

- Nilsson (1998, chpt. 13–16)

- ^

Satplan:

- Russell & Norvig (2003, pp. 402–407),

- Poole, Mackworth & Goebel (1998, pp. 300–301),

- Nilsson (1998, chpt. 21)

- ^

Explanation based learning, relevance based learning, inductive logic programming, case based reasoning:

- Russell & Norvig (2003, pp. 678–710),

- Poole, Mackworth & Goebel (1998, pp. 414–416),

- Luger & Stubblefield (2004, pp. ~422–442),

- Nilsson (1998, chpt. 10.3, 17.5)

- ^

Propositional logic:

- Russell & Norvig (2003, pp. 204–233),

- Luger & Stubblefield (2004, pp. 45–50)

- Nilsson (1998, chpt. 13)

- ^ First-order logic and features such as equality:

- Russell & Norvig (2003, pp. 240–310),

- Poole, Mackworth & Goebel (1998, pp. 268–275),

- Luger & Stubblefield (2004, pp. 50–62),

- Nilsson (1998, chpt. 15)

- ^

Fuzzy logic:

- Russell & Norvig (2003, pp. 526–527)

- Scientific American (1999)

- ^ Abe, Jair Minoro; Nakamatsu, Kazumi (2009). "Multi-agent Systems and Paraconsistent Knowledge". Knowledge Processing and Decision Making in Agent-Based Systems. Studies in Computational Intelligence. Vol. 170. Springer Berlin Heidelberg. pp. 101–121. doi:10.1007/978-3-540-88049-3_5. eISSN 1860-9503. ISBN 978-3-540-88048-6. ISSN 1860-949X. Archived from the original on 9 February 2023. Retrieved 2 August 2022.

- ^

Stochastic methods for uncertain reasoning:

- Russell & Norvig (2003, pp. 462–644),

- Poole, Mackworth & Goebel (1998, pp. 345–395),

- Luger & Stubblefield (2004, pp. 165–191, 333–381),

- Nilsson (1998, chpt. 19)

- ^

Bayesian networks:

- Russell & Norvig (2003, pp. 492–523),

- Poole, Mackworth & Goebel (1998, pp. 361–381),

- Luger & Stubblefield (2004, pp. ~182–190, ≈363–379),

- Nilsson (1998, chpt. 19.3–4)

- ^ Domingos (2015), chapter 6.

- ^

Bayesian inference algorithm:

- Russell & Norvig (2003, pp. 504–519),

- Poole, Mackworth & Goebel (1998, pp. 361–381),

- Luger & Stubblefield (2004, pp. ~363–379),

- Nilsson (1998, chpt. 19.4 & 7)

- ^ Domingos (2015), p. 210.

- ^ والتعلم البايزي (باستخدام خوارزمية تعظيم التوقع)

- Russell & Norvig (2003, pp. 712–724),

- Poole, Mackworth & Goebel (1998, pp. 424–433),

- Nilsson (1998, chpt. 20)

- Domingos (2015, p. 210)

- ^ Bayesian decision theory and Bayesian decision networks:

- Russell & Norvig (2003, pp. 597–600)

- ^ أ ب ت Stochastic temporal models:

- Russell & Norvig (2003, pp. 537–581)

- Russell & Norvig (2003, pp. 551–557)

- (Russell & Norvig 2003, pp. 549–551)

- Russell & Norvig (2003, pp. 551–557)

- ^

decision theory and decision analysis:

- Russell & Norvig (2003, pp. 584–597),

- Poole, Mackworth & Goebel (1998, pp. 381–394)

- ^

Information value theory:

- Russell & Norvig (2003, pp. 600–604)

- ^ Markov decision processes and dynamic decision networks:

- Russell & Norvig (2003, pp. 613–631)

- ^ Game theory and mechanism design:

- Russell & Norvig (2003, pp. 631–643)

- ^

Statistical learning methods and classifiers:

- Russell & Norvig (2003, pp. 712–754),

- Luger & Stubblefield (2004, pp. 453–541)

- ^

Decision tree:

- Domingos (2015, p. 88)

- Russell & Norvig (2003, pp. 653–664),

- Poole, Mackworth & Goebel (1998, pp. 403–408),

- Luger & Stubblefield (2004, pp. 408–417)

- ^

K-nearest neighbor algorithm:

- Domingos (2015, p. 187)

- Russell & Norvig (2003, pp. 733–736)

- ^

kernel methods such as the support vector machine:

- Domingos (2015, p. 88)

- Russell & Norvig (2003, pp. 749–752)

- Russell & Norvig (2003, pp. 725–727)

- ^ Domingos (2015), p. 152.

- ^

Naive Bayes classifier:

- Domingos (2015, p. 152)

- Russell & Norvig (2003, p. 718)

- ^ أ ب

Neural networks:

- Russell & Norvig (2003, pp. 736–748),

- Poole, Mackworth & Goebel (1998, pp. 408–414),

- Luger & Stubblefield (2004, pp. 453–505),

- Nilsson (1998, chpt. 3)

- Domingos (2015, Chapter 4)

- ^

Classifier performance:

- van der Walt & Bernard (2006)

- Russell & Norvig (2009, 18.12: Learning from Examples: Summary)

- ^

Backpropagation:

- Russell & Norvig (2003, pp. 744–748),

- Luger & Stubblefield (2004, pp. 467–474),

- Nilsson (1998, chpt. 3.3)

- ^

Competitive learning, Hebbian coincidence learning, Hopfield networks and attractor networks:

- Luger & Stubblefield (2004, pp. 474–505)

- ^

Feedforward neural networks, perceptrons and radial basis networks:

- Russell & Norvig (2003, pp. 739–748, 758)

- Luger & Stubblefield (2004, pp. 458–467)

- ^ Schulz & Behnke (2012).

- ^ Deep learning:

- ^ Deng & Yu (2014), pp. 199–200.

- ^ Ciresan, Meier & Schmidhuber (2012).

- ^ Fukushima (2007).

- ^

Recurrent neural networks, Hopfield nets:

- Russell & Norvig (2003, p. 758)

- Luger & Stubblefield (2004, pp. 474–505)

- Schmidhuber (2015)

- ^

Recurrent neural networks, Hopfield nets:

- Russell & Norvig (2003, p. 758)

- Luger & Stubblefield (2004, pp. 474–505)

- Schmidhuber (2015)

- ^ Schmidhuber (2015).

- ^ Werbos (1988); Robinson & Fallside (1987); Williams & Zipser (1994)

- ^ Goodfellow, Bengio & Courville (2016); Hochreiter (1991)

- ^ Hochreiter & Schmidhuber (1997); Gers , Schraudolph & Schraudolph (2002)

- ^ Russell & Norvig (2009), p. 1.

- ^ European Commission (2020), p. 1.

- ^ CNN (2006).

- ^ Targeted advertising:

- ^ Lohr (2016).

- ^ Smith (2016).

- ^ Rowinski (2013).

- ^ Frangoul (2019).

- ^ Brown (2019).

- ^ "Artificial intelligence, immune to fear or favour, is helping to make China's foreign policy | South China Morning Post". 2023-03-25. Archived from the original on 25 March 2023. Retrieved 2023-03-26.

- ^ McCorduck (2004), pp. 480–483.

- ^ Markoff (2011).

- ^ Google (2016); BBC (2016)

- ^ Solly (2019).

- ^ Bowling et al. (2015).

- ^ Anadiotis (2020).

- ^ Heath (2020).

- ^ Aletras et al. (2016).

- ^ "AI Content Detector - Detect ChatGPT Plagiarism". contentdetector.ai. Archived from the original on 15 March 2023. Retrieved 2023-03-16.

- ^ "Going Nowhere Fast? Smart Traffic Lights Can Help Ease Gridlock". 18 May 2022. Archived from the original on 22 December 2022. Retrieved 22 December 2022.

- ^ "Intellectual Property and Frontier Technologies". WIPO. Archived from the original on 2 April 2022. Retrieved 30 March 2022.

- ^ أ ب "WIPO Technology Trends 2019 – Artificial Intelligence" (PDF). WIPO. 2019. Archived (PDF) from the original on 2022-10-09.

- ^ أ ب Turing (1950), p. 1.

- ^

Turing's original publication of the Turing test in "Computing machinery and intelligence":

Historical influence and philosophical implications:

- Haugeland (1985, pp. 6–9)

- Crevier (1993, p. 24)

- McCorduck (2004, pp. 70–71)

- Russell & Norvig (2021, pp. 2 and 984)

- ^ Turing (1950), Under "The Argument from Consciousness".

- ^ Russell & Norvig (2021), chpt. 2.

- ^ Russell & Norvig (2021), p. 3.

- ^ Maker (2006).

- ^ McCarthy 1999.

- ^ Minsky (1986).

- ^ "Artificial intelligence - Google Search". www.google.com. Archived from the original on 1 December 2022. Retrieved 2022-11-05.

- ^ Nilsson (1983), p. 10.

- ^ Haugeland (1985), pp. 112–117.

- ^

Physical symbol system hypothesis:

- Newell & Simon (1976, p. 116)

- McCorduck (2004, p. 153)

- Russell & Norvig (2003, p. 18)

- ^

Moravec's paradox:

- Moravec (1988, pp. 15–16)

- Minsky (1986, p. 29)

- Pinker (2007, pp. 190–91)

- ^

Dreyfus' critique of AI:

Historical significance and philosophical implications:

- Crevier (1993, pp. 120–132)

- McCorduck (2004, pp. 211–239)

- Russell & Norvig (2003, pp. 950–952)

- Fearn (2007, Chpt. 3)

- ^ Crevier (1993), p. 125.

- ^ Langley (2011).

- ^ Katz (2012).

- ^

Neats vs. scruffies, the historic debate:

- McCorduck (2004, pp. 421–424, 486–489)

- Crevier (1993, p. 168)

- Nilsson (1983, pp. 10–11)

- ^ Russell & Norvig (2003), pp. 25–26.

- ^ Pennachin & Goertzel (2007).

- ^ أ ب Roberts (2016).

- ^ أ ب Russell & Norvig (2003), p. 947.

- ^ Chalmers (1995).

- ^ Dennett (1991).

- ^ Horst (2005).

- ^ Searle (1999).

- ^ Searle (1980), p. 1.

- ^

Searle's Chinese room argument:

- Searle (1980). Searle's original presentation of the thought experiment.

- Searle (1999).

- Russell & Norvig (2003, pp. 958–960)

- McCorduck (2004, pp. 443–445)

- Crevier (1993, pp. 269–271)

- ^

Robot rights:

- Russell & Norvig (2003, p. 964)

- BBC (2006)

- Maschafilm (2010) (the film Plug & Pray)

- ^ Evans (2015).

- ^ McCorduck (2004), pp. 19–25.

- ^ Henderson (2007).

- ^ Omohundro (2008).

- ^ Vinge (1993).

- ^ Russell & Norvig (2003), p. 963.

- ^ Transhumanism:

- ^

AI as evolution:

- Edward Fredkin is quoted in McCorduck (2004, p. 401)

- Butler (1863)

- Dyson (1998)

- ^ Ford & Colvin (2015); McGaughey (2018)

- ^ IGM Chicago (2017).

- ^ Arntz, Gregory & Zierahn (2016), p. 33.

- ^ Lohr (2017); Frey & Osborne (2017); Arntz, Gregory & Zierahn (2016, p. 33)

- ^ Morgenstern (2015).

- ^ Mahdawi (2017); Thompson (2014)

- ^ Harari (2018).

- ^ Weaponized AI:

- ^ Urbina, Fabio; Lentzos, Filippa; Invernizzi, Cédric; Ekins, Sean (7 March 2022). "Dual use of artificial-intelligence-powered drug discovery". Nature Machine Intelligence. 4 (3): 189–191. doi:10.1038/s42256-022-00465-9. PMC 9544280. PMID 36211133. S2CID 247302391.

- ^ CNA (2019).

- ^ Goffrey (2008), p. 17.

- ^ Lipartito (2011, p. 36); Goodman & Flaxman (2017, p. 6)

- ^ Larson & Angwin (2016).

- ^ Berdahl, Carl Thomas; Baker, Lawrence; Mann, Sean; Osoba, Osonde; Girosi, Federico (2023-02-07). "Strategies to Improve the Impact of Artificial Intelligence on Health Equity: Scoping Review". JMIR AI (in الإنجليزية). 2: e42936. doi:10.2196/42936. ISSN 2817-1705. S2CID 256681439. Archived from the original on 21 February 2023. Retrieved 21 February 2023.

{{cite journal}}: CS1 maint: unflagged free DOI (link) - ^ Dockrill, Peter, Robots With Flawed AI Make Sexist And Racist Decisions, Experiment Shows Archived 27 يونيو 2022 at the Wayback Machine, Science Alert, 27 June 2022

- ^ Cellan-Jones (2014).

- ^ Bostrom (2014); Müller & Bostrom (2014); Bostrom (2015)

- ^ Rubin (2003).

- ^ Müller & Bostrom (2014).

- ^ Leaders' concerns about the existential risks of AI:

- ^ Funding to mitigate risks of AI:

- ^ Leaders who argue the benefits of AI outweigh the risks:

- ^ Arguments that AI is not an imminent risk:

- ^ Brooks (2014).

- ^ "Artificial intelligence and copyright". www.wipo.int (in الإنجليزية). Archived from the original on 24 May 2022. Retrieved 27 May 2022.

- ^ Hugenholtz, P. Bernt; Quintais, João Pedro (October 2021). "Copyright and Artificial Creation: Does EU Copyright Law Protect AI-Assisted Output?". IIC - International Review of Intellectual Property and Competition Law (in الإنجليزية). 52 (9): 1190–1216. doi:10.1007/s40319-021-01115-0. ISSN 0018-9855.

- ^ Yudkowsky (2008).

- ^ أ ب Anderson & Anderson (2011).

- ^ AAAI (2014).

- ^ Wallach (2010).

- ^ Russell (2019), p. 173.

- ^ Regulation of AI to mitigate risks:

- ^ Law Library of Congress (U.S.). Global Legal Research Directorate (2019).

- ^ Kissinger, Henry (1 November 2021). "The Challenge of Being Human in the Age of AI". The Wall Street Journal. Archived from the original on 4 November 2021. Retrieved 4 November 2021.

- ^ Buttazzo (2001).

- ^ Anderson (2008).

- ^ McCauley (2007).

- ^ Galvan (1997).

AI textbooks

These were the four the most widely used AI textbooks in 2008: