دمج المجسات

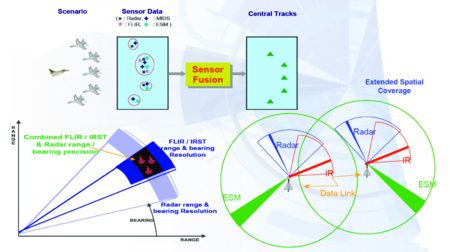

دمج الحساسات Sensor fusion وهو جمع بين بيانات استشعارية أو البيانات المستمدة من مصادر متباينة بحيث تكون المعلومات الناتجة ذات مصدر ريبة أقل مما قد يكون ممكنًا عند استخدام هذه المصادر بشكل فردي. يمكن أن يعني مصطلح "تقليل عدم اليقين" في هذه الحالة أكثر دقة أو اكتمالًا أو أكثر موثوقية ، أو يشير إلى نتيجة وجهة نظر ناشئة ، مثل رؤية مجسمة (أي حساب عمق معلومات من خلال الجمع بين صور ثنائية الأبعاد من كاميرتين في أمكنة مراقبة مختلفة قليلاً).[1][2]

لم يتم تحديد مصادر البيانات لعملية الجمع من أجهزة استشعار متطابقة. يمكن للمرء أن يميز "الجمع المباشر" و "الجمع غير المباشر" واندماج نواتج الاثنين السابقين. الاندماج المباشر هو جمع بيانات المستشعر من مجموعة من غير متجانسة أو متجانسة؛ و مستشعر برمجي ، و قيمة مسجلة من بيانات المستشعر ، بينما يستخدم الجمع غير المباشر مصادر معلومات مثل معرفة أولية حول البيئة والمدخلات البشرية.

يُعرف دمج الحساس أيضًا باسم (مستشعرات متعددة) دمج البيانات وهو مجموعة فرعية من دمج المعلومات.

أمثلة لحساسات

- مقياس التسارع Accelerometer

- (ESM) تدابير الدعم الإلكتروني Electronic Support Measures

- Flash LIDAR

- Global Positioning System (GPS) نظام تحديد المواقع العالمي

- Infrared / thermal imaging camera كاميرا التصوير بالأشعة تحت الحمراء / الحرارية

- الحساسات المغنطيسية

- MEMS

- المصفوفة الطورية

- رادار

- المناظير الراديوية، مثل مصفوفة كيلو متر مربع Square Kilometre Array، المقترحة وهي أكبر مستشعر على الإطلاق

- ليدار الماسح Scanning LIDAR

- مقياس الزلازل Seismic sensor

- سونار Sonar و باقي الحساسات الصوتية

- Sonobuoys

- كاميرا التلفزيون TV Cameras

- →قائمة حساسات إضافية

خوارزميات

دمج الحساس هو مصطلح يغطي عددًا من الطرق والخوارزميات ، بما في ذلك:

- نظرية النهايات المركزية Central limit theorem

- مرشح كالمَن Kalman filter[3]

- الشبكات البايزية Bayesian networks

- Dempster-Shafer

- الشبكة العصبية التلافيفية Convolutional neural network

حسابات كأمثلة

يتم توضيح مثالين لحسابات دمج الحساس أدناه. ليكن و تشير إلى قياسين من أجهزة الاستشعار مع تباينات التشويش و ، على التوالي. توجد طريقة واحدة للحصول على قياس مشترك هو تطبيق نظرية النهايات المركزية ، والتي يتم استخدامها أيضًا في Fraser-Potter ذات الفاصل الثابت الأكثر سلاسة ، وهي [4]

- ,

حيث هو اختلاف التقدير المجمع. يمكن ملاحظة أن النتيجة المدمجة هي ببساطة مجموعة خطية من القياسين المرجحين بتباينات التشويش الخاصة بكل منهما.

طريقة أخرى لدمج قياسين هي استخدام مرشح كالمَن الأمثل. لنفترض أن البيانات يتم إنشاؤها بواسطة نظام من الدرجة الأولى ليكن تشير إلى حل معادلة ركاتي للمرشح. من خلال تطبيق قاعدة كرامر ضمن حساب الربح ، يمكن العثور على ربح المرشح من خلال:[citation needed]

عن طريق المراقبة ، عندما يكون القياس الأول خاليًا من التشويش ، يتجاهل المرشح القياس الثاني والعكس صحيح. أي أن التقدير المشترك يتم ترجيحه بجودة القياسات.

مركزية مقابل لا مركزية

في دمج الحساسات ، تشير المركزية مقابل اللامركزية إلى مكان جمع البيانات. في الدمج المركزي ، يقوم العملاء ببساطة بإعادة توجيه جميع البيانات إلى موقع مركزي ، وبعض الكيانات في الموقع المركزي مسؤولة عن ربط البيانات ودمجها. في اللامركزية ، يتحمل العملاء المسؤولية الكاملة عن دمج البيانات. "في هذه الحالة ، يمكن اعتبار كل مستشعر أو نظام أساسي كأصل ذكي يتمتع بدرجة ما من الاستقلالية في صنع القرار."[5]

توجد مجموعات متعددة من الأنظمة المركزية واللامركزية.

يشير تصنيف آخر لتكوين المستشعر إلى تنسيق تدفق المعلومات بين المستشعرات.[6][7] توفر هذه الآليات طريقة لحل التعارضات أو التضاربات والسماح بتطوير استراتيجيات الاستشعار الديناميكية. تكون الحساسات في تكوين فائض (أو تنافسي) إذا قدمت كل عقدة قياسات مستقلة لنفس الخصائص. يمكن استخدام هذا التكوين في تصحيح الأخطاء عند مقارنة المعلومات من عقد متعددة. غالبًا ما تُستخدم الاستراتيجيات الزائدة مع عمليات دمج عالية المستوى في إجراءات التفضيل.[8][9] يحدث التكوين التكميلي عندما توفر مصادر معلومات متعددة معلومات مختلفة حول نفس الميزات. تُستخدم هذه الاستراتيجية لدمج المعلومات على مستوى البيانات الأولية ضمن خوارزميات اتخاذ القرار. يتم تطبيق الميزات التكميلية عادةً في مهام التعرف على الحركة مع الشبكة العصبية,[10][11] نموذج ماركوڤ الكامن,[12][13] دعم آلات المتجهات,[14] طرق التجميع وتقنيات أخرى.[14][13] يستخدم اندماج الحساس المشترك المعلومات المستخرجة بواسطة حساسات مستقلة متعددة لتوفير معلومات لن تكون متاحة من حساسات واحدة. على سبيل المثال ، يتم استخدام أجهزة الاستشعار المتصلة بأجزاء الجسم للكشف عن الزاوية بينهما. تعطي إستراتيجية الحساس المشترك معلومات مستحيلة الحصول عليها من العقد المفردة. يمكن استخدام دمج المعلومات المشتركة في التعرف على الحركة,[15] تحليل السرعة, تحليل الحركة,[16][17],.[18]

مستويات

هناك عدة فئات أو مستويات من دمج الحساسات الشائعة الاستخدام. *[19] [20] [21] [22] [23] [24]

- المستوى 0 – انتظام البيانات

- المستوى 1 – تقييم البنية (مثل الإشارة / الصورة / المادة).

- التتبع والكشف عن الأشياء / إدراكها / التعرف عليها

- المستوى 2 - تقييم الموقف

- المستوى 3 - تقييم التأثير

- المستوى 4 - تحسين العملية (أي إدارة الحساس)

- المستوى 5 - تنقيح المستخدم

يمكن أيضًا تحديد مستوى دمج الحساسات بناءً على نوع المعلومات المستخدمة لتزويد خوارزمية الجمع.[25] بتعبير أدق ، يمكن إجراء دمج الحساسات بدمج البيانات الخام القادمة من مصادر مختلفة ، أو ميزات مستنبطة ، أو حتى اتخاذ قرار من العقد الفردية.

- مستوى البيانات - يهدف الجمع على مستوى البيانات (أو مبدأياً) إلى دمج البيانات الخام من مصادر متعددة ويمثل تقنية الدمج عند أدنى مستوى من التجريد. فهي تقنية دمج الحساسات الأكثر شيوعًا في العديد من مجالات التطبيق. تهدف خوارزميات دمج مستوى البيانات عادةً إلى الجمع بين مصادر متجانسة متعددة للبيانات الحسية لتحقيق قراءات أكثر دقة وتركيبية.[26] عندما يتم استخدام الأجهزة المحمولة ، يمثل ضغط البيانات عاملاً مهمًا ، نظرًا لأن جمع المعلومات الأولية من مصادر متعددة يولد مساحات معلومات ضخمة يمكن أن تحدد مشكلة فيما يتعلق بالذاكرة أو النطاق الترددي للاتصالات للأنظمة المحمولة. يميل دمج المعلومات على مستوى البيانات إلى إنشاء مساحات إدخال كبيرة ، مما يبطئ إجراءات اتخاذ القرار. أيضا ، في كثير من الأحيان لا يمكن دمج مستوى البيانات معالجة القياسات غير المكتملة. إذا أصبحت طريقة أحد أجهزة الاستشعار عديمة الفائدة بسبب الأعطال أو الانهيار أو أسباب أخرى يمكن أن تعمل الأنظمة بأكملها في نتائج غامضة.

- مستوى الخصوصية أو الملامح - تمثل الميزات المعلومات المحسوبة على متن كل عقدة استشعار. ثم يتم إرسال هذه الميزات إلى عقدة الجمع لتغذية خوارزمية الدمج.[27] يولد هذا الإجراء مساحات معلومات أصغر فيما يتعلق بدمج مستوى البيانات ، وهذا أفضل من حيث الحمل الحسابي. من الواضح أنه من المهم اختيار الميزات التي تحدد إجراءات التصنيف بشكل صحيح: يجب أن يكون اختيار مجموعة الميزات الأكثر كفاءة جانبًا رئيسيًا في تصميم الطريقة. يؤدي استخدام خوارزميات اختيار الميزات التي تكتشف الميزات المترابطة والمجموعات الفرعية للميزات بشكل صحيح إلى تحسين دقة التعرف ولكن مجموعات التدريب الكبيرة مطلوبة عادةً للعثور على أهم مجموعة فرعية للميزات.[25]

- مستوى القرار - الاندماج على مستوى القرار (أو أخيراً) هو إجراء اختيار فرضية من مجموعة من الفرضيات الناتجة عن قرارات مستقلة (عادة ما تكون أضعف) للعقد المتعددة.[28] وهو أعلى مستوى من التجريد ويستخدم المعلومات التي تم تفصيلها بالفعل من خلال معالجة البيانات الأولية أو مستوى الميزة. الهدف الرئيسي في دمج القرار هو استخدام المرحلة على مستوى التعريف بينما تتم معالجة البيانات من العقد مسبقًا عن طريق استخراج الميزات منها.[29] عادةً ما يتم استخدام جمع حساس مستوى القرار في تصنيف أنشطة التعرف ، وأكثر الأساليب شيوعًا هي الانتخاب بالأكثرية و Naive-Bayes.[citation needed] تشمل المزايا الناتجة عن دمج مستوى القرار النطاق الترددي للاتصالات وتحسين دقة القرار. كما يسمح بمزيج من أجهزة الحساسات غير المتجانسة.[27]

تطبيقات

أحد تطبيقات دمج الحساسات هو GPS / INS ، حيث يتم دمج بيانات نظام تحديد المواقع العالمي و نظام الملاحة بالقصور الذاتي باستخدام طرق مختلفة متنوعة، على سبيل المثال مرشح كالمان الموسع. يفيد هذا ، على سبيل المثال ، في تحديد ارتفاع الطائرة باستخدام أجهزة استشعار منخفضة التكلفة.[30]مثال آخر هو استخدام نهج دمج البيانات لتحديد حالة حركة المرور (حركة المرور المنخفضة ، ازدحام حركة المرور ، التدفق المتوسط) باستخدام بيانات الصوت والصورة والحساسات الصوتية المجمعة على جانب الطريق.[31]في مجال دمج حساسات القيادة المستقلة يُستخدم لدمج المعلومات الزائدة من أجهزة الاستشعار التكميلية من أجل الحصول على تمثيل أكثر دقة وموثوقية للبيئة.[32]

على الرغم من أنها ليست طريقة مخصصة لدمج المستشعرات من الناحية الفنية ، إلا أن الأساليب الحديثة للشبكة العصبية التلافيفية يمكن أن تعالج في وقت واحد العديد من قنوات بيانات الحساس (مثل التصوير فوق الطيفي مع مئات النطاقات[33]) ودمج المعلومات ذات الصلة للحصول على نتائج التصنيف.

انظر أيضاً

- Brooks – Iyengar algorithm

- Data (computing)

- Data mining

- Fisher's method for combining independent tests of significance

- Image fusion

- Multimodal integration

- Sensor grid

- Transducer Markup Language (TML) is an XML based markup language which enables sensor fusion.

مراجع

- ^ Elmenreich, W. (2002). Sensor Fusion in Time-Triggered Systems, PhD Thesis (PDF). Vienna, Austria: Vienna University of Technology. p. 173.

- ^ Haghighat, Mohammad Bagher Akbari; Aghagolzadeh, Ali; Seyedarabi, Hadi (2011). "Multi-focus image fusion for visual sensor networks in DCT domain". Computers & Electrical Engineering. 37 (5): 789–797. doi:10.1016/j.compeleceng.2011.04.016.

- ^ Li, Wangyan; Wang, Zidong; Wei, Guoliang; Ma, Lifeng; Hu, Jun; Ding, Derui (2015). "A Survey on Multisensor Fusion and Consensus Filtering for Sensor Networks". Discrete Dynamics in Nature and Society (in الإنجليزية). 2015: 1–12. doi:10.1155/2015/683701. ISSN 1026-0226.

- ^ Maybeck, S. (1982). Stochastic Models, Estimating, and Control. River Edge, NJ: Academic Press.

- ^ N. Xiong; P. Svensson (2002). "Multi-sensor management for information fusion: issues and approaches". Information Fusion. p. 3(2):163–186.

- ^ Durrant-Whyte, Hugh F. (2016). "Sensor Models and Multisensor Integration". The International Journal of Robotics Research. 7 (6): 97–113. doi:10.1177/027836498800700608. ISSN 0278-3649.

- ^ Galar, Diego; Kumar, Uday (2017). eMaintenance: Essential Electronic Tools for Efficiency. Academic Press. p. 26. ISBN 9780128111543.

- ^ Li, Wenfeng; Bao, Junrong; Fu, Xiuwen; Fortino, Giancarlo; Galzarano, Stefano (2012). "Human Postures Recognition Based on D-S Evidence Theory and Multi-sensor Data Fusion". 2012 12th IEEE/ACM International Symposium on Cluster, Cloud and Grid Computing (ccgrid 2012). pp. 912–917. doi:10.1109/CCGrid.2012.144. ISBN 978-1-4673-1395-7.

- ^ Fortino, Giancarlo; Gravina, Raffaele (2015). "Fall-MobileGuard: a Smart Real-Time Fall Detection System". Proceedings of the 10th EAI International Conference on Body Area Networks. doi:10.4108/eai.28-9-2015.2261462. ISBN 978-1-63190-084-6.

- ^ Tao, Shuai; Zhang, Xiaowei; Cai, Huaying; Lv, Zeping; Hu, Caiyou; Xie, Haiqun (2018). "Gait based biometric personal authentication by using MEMS inertial sensors". Journal of Ambient Intelligence and Humanized Computing. 9 (5): 1705–1712. doi:10.1007/s12652-018-0880-6. ISSN 1868-5137.

- ^ Dehzangi, Omid; Taherisadr, Mojtaba; ChangalVala, Raghvendar (2017). "IMU-Based Gait Recognition Using Convolutional Neural Networks and Multi-Sensor Fusion". Sensors. 17 (12): 2735. doi:10.3390/s17122735. ISSN 1424-8220. PMC 5750784. PMID 29186887.

{{cite journal}}: CS1 maint: unflagged free DOI (link) - ^ Guenterberg, E.; Yang, A.Y.; Ghasemzadeh, H.; Jafari, R.; Bajcsy, R.; Sastry, S.S. (2009). "A Method for Extracting Temporal Parameters Based on Hidden Markov Models in Body Sensor Networks With Inertial Sensors" (PDF). IEEE Transactions on Information Technology in Biomedicine. 13 (6): 1019–1030. doi:10.1109/TITB.2009.2028421. ISSN 1089-7771. PMID 19726268.

- ^ أ ب Parisi, Federico; Ferrari, Gianluigi; Giuberti, Matteo; Contin, Laura; Cimolin, Veronica; Azzaro, Corrado; Albani, Giovanni; Mauro, Alessandro (2016). "Inertial BSN-Based Characterization and Automatic UPDRS Evaluation of the Gait Task of Parkinsonians". IEEE Transactions on Affective Computing. 7 (3): 258–271. doi:10.1109/TAFFC.2016.2549533. ISSN 1949-3045.

- ^ أ ب Gao, Lei; Bourke, A.K.; Nelson, John (2014). "Evaluation of accelerometer based multi-sensor versus single-sensor activity recognition systems". Medical Engineering & Physics. 36 (6): 779–785. doi:10.1016/j.medengphy.2014.02.012. ISSN 1350-4533. PMID 24636448.

- ^ Xu, James Y.; Wang, Yan; Barrett, Mick; Dobkin, Bruce; Pottie, Greg J.; Kaiser, William J. (2016). "Personalized Multilayer Daily Life Profiling Through Context Enabled Activity Classification and Motion Reconstruction: An Integrated System Approach". IEEE Journal of Biomedical and Health Informatics. 20 (1): 177–188. doi:10.1109/JBHI.2014.2385694. ISSN 2168-2194. PMID 25546868.

- ^ Chia Bejarano, Noelia; Ambrosini, Emilia; Pedrocchi, Alessandra; Ferrigno, Giancarlo; Monticone, Marco; Ferrante, Simona (2015). "A Novel Adaptive, Real-Time Algorithm to Detect Gait Events From Wearable Sensors". IEEE Transactions on Neural Systems and Rehabilitation Engineering. 23 (3): 413–422. doi:10.1109/TNSRE.2014.2337914. ISSN 1534-4320. PMID 25069118.

- ^ Wang, Zhelong; Qiu, Sen; Cao, Zhongkai; Jiang, Ming (2013). "Quantitative assessment of dual gait analysis based on inertial sensors with body sensor network". Sensor Review. 33 (1): 48–56. doi:10.1108/02602281311294342. ISSN 0260-2288.

- ^ Kong, Weisheng; Wanning, Lauren; Sessa, Salvatore; Zecca, Massimiliano; Magistro, Daniele; Takeuchi, Hikaru; Kawashima, Ryuta; Takanishi, Atsuo (2017). "Step Sequence and Direction Detection of Four Square Step Test" (PDF). IEEE Robotics and Automation Letters. 2 (4): 2194–2200. doi:10.1109/LRA.2017.2723929. ISSN 2377-3766.

- ^ Rethinking JDL Data Fusion Levels

- ^ Blasch, E., Plano, S. (2003) “Level 5: User Refinement to aid the Fusion Process”, Proceedings of the SPIE, Vol. 5099.

- ^ (2004) "Revisiting the JDL data fusion model II" in International Conference on Information Fusion..

- ^ Blasch, E. (2006) "Sensor, user, mission (SUM) resource management and their interaction with level 2/3 fusion[dead link]" International Conference on Information Fusion.

- ^ http://defensesystems.com/articles/2009/09/02/c4isr1-sensor-fusion.aspx

- ^ Blasch, E., Steinberg, A., Das, S., Llinas, J., Chong, C.-Y., Kessler, O., Waltz, E., White, F. (2013) "Revisiting the JDL model for information Exploitation," International Conference on Information Fusion.

- ^ أ ب Gravina, Raffaele; Alinia, Parastoo; Ghasemzadeh, Hassan; Fortino, Giancarlo (2017). "Multi-sensor fusion in body sensor networks: State-of-the-art and research challenges". Information Fusion. 35: 68–80. doi:10.1016/j.inffus.2016.09.005. ISSN 1566-2535.

- ^ Gao, Teng; Song, Jin-Yan; Zou, Ji-Yan; Ding, Jin-Hua; Wang, De-Quan; Jin, Ren-Cheng (2015). "An overview of performance trade-off mechanisms in routing protocol for green wireless sensor networks". Wireless Networks. 22 (1): 135–157. doi:10.1007/s11276-015-0960-x. ISSN 1022-0038.

- ^ أ ب Chen, Chen; Jafari, Roozbeh; Kehtarnavaz, Nasser (2015). "A survey of depth and inertial sensor fusion for human action recognition". Multimedia Tools and Applications. 76 (3): 4405–4425. doi:10.1007/s11042-015-3177-1. ISSN 1380-7501.

- ^ Banovic, Nikola; Buzali, Tofi; Chevalier, Fanny; Mankoff, Jennifer; Dey, Anind K. (2016). "Modeling and Understanding Human Routine Behavior". Proceedings of the 2016 CHI Conference on Human Factors in Computing Systems - CHI '16. pp. 248–260. doi:10.1145/2858036.2858557. ISBN 9781450333627.

- ^ Maria, Aileni Raluca; Sever, Pasca; Carlos, Valderrama (2015). "Biomedical sensors data fusion algorithm for enhancing the efficiency of fault-tolerant systems in case of wearable electronics device". 2015 Conference Grid, Cloud & High Performance Computing in Science (ROLCG). pp. 1–4. doi:10.1109/ROLCG.2015.7367228. ISBN 978-6-0673-7040-9.

- ^ Gross, Jason; Yu Gu; Matthew Rhudy; Srikanth Gururajan; Marcello Napolitano (July 2012). "Flight Test Evaluation of Sensor Fusion Algorithms for Attitude Estimation". IEEE Transactions on Aerospace and Electronic Systems. 48 (3): 2128–2139. doi:10.1109/TAES.2012.6237583.

- ^ Joshi, V., Rajamani, N., Takayuki, K., Prathapaneni, N., Subramaniam, L. V. (2013). "Information Fusion Based Learning for Frugal Traffic State Sensing" in Proceedings of the Twenty-Third International Joint Conference on Artificial Intelligence..

- ^ Mircea Paul, Muresan; Ion, Giosan; Sergiu, Nedevschi (2020-02-18). "Stabilization and Validation of 3D Object Position Using Multimodal Sensor Fusion and Semantic Segmentation". Sensors. 20 (4): 1110. doi:10.3390/s20041110. PMID 32085608.

- ^ Ran, Lingyan; Zhang, Yanning; Wei, Wei; Zhang, Qilin (2017-10-23). "A Hyperspectral Image Classification Framework with Spatial Pixel Pair Features". Sensors. 17 (10): 2421. doi:10.3390/s17102421. PMC 5677443. PMID 29065535.

{{cite journal}}: CS1 maint: unflagged free DOI (link)

وصلات خارجية

- ^ Haghighat, Mohammad; Abdel-Mottaleb, Mohamed; Alhalabi, Wadee (2016). "Discriminant Correlation Analysis: Real-Time Feature Level Fusion for Multimodal Biometric Recognition". IEEE Transactions on Information Forensics and Security. 11 (9): 1984–1996. doi:10.1109/TIFS.2016.2569061.